أهلاً وسهلاً بجميع الأصدقاء والمتابعين الأعزاء! اليوم، أريد أن أتحدث معكم عن موضوع يشغل بالي كثيرًا، ويلامس حياتنا اليومية بشكل لم نكن نتخيله قبل سنوات قليلة.

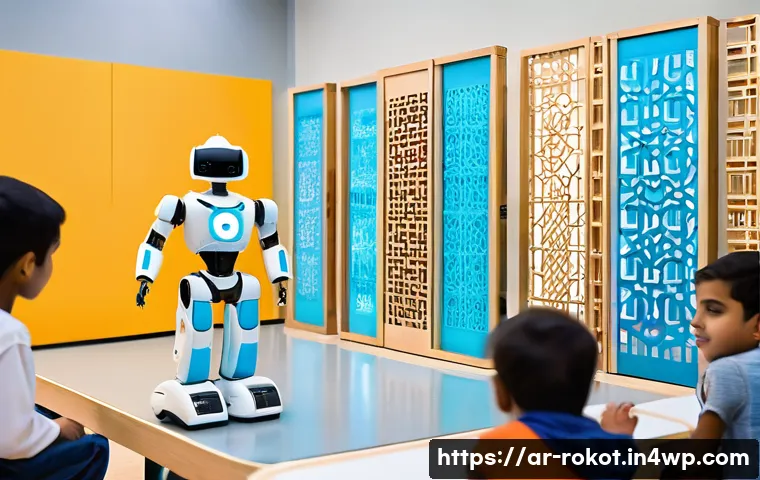

أنا شخصياً، وأنا أرى كيف تتطور التكنولوجيا من حولنا، أشعر بالدهشة تارة وبالقلق تارة أخرى. هذه الآلات الذكية والروبوتات لم تعد مجرد خيال علمي، بل أصبحت جزءًا لا يتجزأ من واقعنا، من السيارات ذاتية القيادة إلى أنظمة خدمة العملاء التي تتفاعل معنا كالبشر تمامًا.

هل فكرتم يومًا في الأخلاقيات التي يجب أن تحكم تصرفات هذه الروبوتات؟ أو بالأحرى، من يضع هذه القواعد؟لقد أدركت مؤخرًا أن هذا ليس مجرد سؤال فلسفي، بل هو تحدٍ حقيقي يواجه مجتمعاتنا الآن ومستقبلًا.

فالشركات الكبرى التي تقف وراء هذه الابتكارات تحمل على عاتقها مسؤولية هائلة، تتجاوز مجرد الربح المادي. تجاربي ومشاهداتي المستمرة في عالم التكنولوجيا قادتني إلى استنتاج مفاده أن الدور الذي تلعبه هذه المؤسسات في تشكيل مستقبل أخلاقيات الروبوتات أمر حاسم للغاية.

الأمر لا يتعلق فقط بالبرمجة، بل بكيفية دمج القيم الإنسانية في صلب عمل هذه التقنيات. إنها ثورة تتطلب منا جميعًا وقفة تأمل، خاصة مع التطورات السريعة التي نشهدها بفضل نماذج الذكاء الاصطناعي الحديثة التي أصبحت قادرة على فهم السياقات المعقدة واتخاذ قرارات شبه بشرية.

هذه التغيرات تضعنا أمام مفترق طرق، وعلينا أن نكون مستعدين لها. هيا بنا نكتشف سوياً خفايا هذا العالم ونفهم ما هي هذه التحديات وكيف يمكننا التعامل معها بذكاء.

دعونا نتعمق أكثر في هذا الموضوع المثير للاهتمام.

أهلاً بكم يا أصدقائي الكرام، ومرحباً بكم مجدداً في مدونتي! بعد هذه المقدمة التي أثارت لدي الكثير من الأفكار والمشاعر، دعونا نغوص أعمق في صميم هذا النقاش الذي لا يقل أهمية عن أي حديث يدور حول مستقبلنا وحياة أبنائنا.

ففكرة “أخلاقيات الروبوتات” لم تعد مادة لقصص الخيال العلمي، بل هي واقع يفرض نفسه بقوة على موائد النقاش في كبرى الشركات والمحافل الدولية. من واقع تجربتي الشخصية ومتابعتي المستمرة لعالم التكنولوجيا، أرى أننا أمام منعطف حاسم، حيث تتشابك التحديات التقنية مع المعضلات الأخلاقية بشكل لا يمكن فصله.

شركات التكنولوجيا: حراس أم متجاوزون للحدود؟

المسؤولية تتجاوز لوحة المفاتيح

صراحة، عندما أفكر في الشركات العملاقة التي تصنع هذه الروبوتات وأنظمة الذكاء الاصطناعي، يتبادر إلى ذهني سؤال جوهري: هل هي مجرد مطوّرين لأدوات تكنولوجية، أم أنهم حراس لمستقبلنا الأخلاقي؟ لقد رأيت بعيني كيف يمكن لقرار برمجي واحد، يبدو بسيطاً في ظاهره، أن يترك أثراً عميقاً على حياة الأفراد والمجتمعات. تخيلوا معي أن خوارزمية توظيف، مثلاً، تميل لتفضيل جنس على آخر أو عرق على حساب آخر، وهذا ما حدث بالفعل في حالات موثقة! هنا لا نتحدث عن أخطاء تقنية يمكن إصلاحها بسهولة، بل عن تحيزات تتسرب إلى صميم أنظمتنا الاجتماعية عبر هذه التقنيات. المسؤولية هنا لا تتوقف عند لوحة المفاتيح التي كُتبت عليها الأكواد، بل تمتد لتشمل التأثيرات بعيدة المدى على العدالة والمساواة في حياتنا. يجب أن تكون هذه الشركات واعية تمامًا بأن كل سطر برمجي يكتبونه يحمل في طياته وزناً أخلاقياً هائلاً، يؤثر في مصائر البشر.

لماذا تحتاج الشركات إلى بوصلة أخلاقية؟

دعوني أكون صريحة معكم، الربح المادي هو المحرك الأساسي لأي شركة، وهذا أمر مفهوم. لكن، في عالم الذكاء الاصطناعي، أرى أن هذا المفهوم يجب أن يتطور. فالشركات التي تسعى للابتكار دون بوصلة أخلاقية واضحة قد تجد نفسها في مياه عميقة ومشاكل لا حصر لها. ليس الأمر مجرد سمعة، بل هو ثقة المستخدمين والمجتمع بأكمله. إذا فقد الناس الثقة في أنظمة الذكاء الاصطناعي لأنها متحيزة أو غير شفافة، فكيف سيقبلونها في حياتهم اليومية؟ لقد أدركت أن الشركات الرائدة هي التي تستثمر في تطوير مبادئ أخلاقية قوية لتقنياتها، وتدمجها في كل مرحلة من مراحل التصميم والتطوير. هذا لا يحميها فقط من المشاكل القانونية والأخلاقية المحتملة، بل يعزز أيضاً من قدرتها على الابتكار بشكل مسؤول ومستدام. الابتكار الحقيقي، من وجهة نظري، هو الابتكار الذي يخدم البشرية ويحترم قيمها.

الذكاء الاصطناعي والتحيز: صندوق باندورا أم مرآة للواقع؟

حكايات من عالم الخوارزميات المتحيزة

أتذكر جيداً عندما قرأت عن تلك القصص التي كشفت كيف أن بعض أنظمة الذكاء الاصطناعي قد ورثت تحيزات موجودة أصلاً في البيانات التي تدربت عليها. هذا ليس خيالاً، بل هو واقع مرير يجعلنا نتوقف ونتساءل. فعندما تُستخدم بيانات تاريخية تعكس تمييزاً معيناً، فإن الذكاء الاصطناعي يتعلم هذا التمييز ويكرره، بل قد يضخمه! تخيلوا نظاماً للتعرف على الوجوه يجد صعوبة أكبر في التعرف على ذوي البشرة الداكنة، أو نظاماً لتصنيف المخاطر الجنائية يبالغ في تقييم خطورة الأفراد من أقليات معينة. هذه ليست أخطاء بريئة، بل هي انعكاسات خطيرة للتحيزات الاجتماعية التي قد تؤثر على الحريات الأساسية وحقوق الإنسان. أنا كمدونة أرى أن تسليط الضوء على هذه القصص الواقعية أمر بالغ الأهمية، فهو يجعلنا نفهم حجم التحدي وضرورة معالجته بجدية. هذه الأنظمة، في النهاية، ليست سوى مرآة تعكس ما نغذيه بها، فإذا كانت بياناتنا متحيزة، فمخرجاتها ستكون كذلك بلا شك.

تفكيك الصندوق الأسود: الشفافية هي المفتاح

من تجربتي في تتبع هذا المجال، أجد أن الشفافية هي الحجر الأساس في بناء أنظمة ذكاء اصطناعي عادلة. الناس لديهم الحق في فهم كيف تتخذ هذه الآلات القرارات التي تؤثر على حياتهم. فكيف يمكن أن نثق في نظام لا نعرف كيف يعمل؟ هذا هو ما يطلق عليه “الصندوق الأسود” في الذكاء الاصطناعي، حيث تكون آليات اتخاذ القرار غامضة وغير قابلة للتفسير. لمواجهة هذا التحدي، أرى ضرورة ملحة في تطوير تقنيات “الذكاء الاصطناعي القابل للتفسير” (Explainable AI) التي تتيح لنا معرفة الأساس المنطقي وراء كل قرار. الشركات التي تتبنى الشفافية في خوارزمياتها وبياناتها التدريبية هي التي تبني جسور الثقة مع مجتمعاتها. وهذا لا يعني كشف الأسرار التجارية، بل توفير آليات واضحة للمساءلة والتدقيق، تضمن أن العدالة لا تُترك للصدفة أو للتحيز الخوارزمي غير المقصود.

هل يمكن للروبوتات أن تكون عادلة؟ معضلة القرارات الأخلاقية

من سينقذ ومن سيتضرر؟

أتساءل دائمًا، مثل الكثيرين، عن اللحظات الحاسمة التي قد تضطر فيها الروبوتات لاتخاذ قرارات أخلاقية صعبة. تخيلوا معي سيارة ذاتية القيادة تجد نفسها أمام خيارين كلاهما سيء: إما أن تدهس أحد المارة، أو أن تنحرف وتتسبب في ضرر للركاب بداخلها. أي قرار ستتخذ؟ ومن سيضع هذه القواعد؟ هذه ليست مجرد سيناريوهات خيالية، بل هي معضلات حقيقية يواجهها المهندسون والمبرمجون اليوم. فبرمجة الأخلاق في الآلة ليست بالأمر السهل، فهي تتطلب تحويل القيم الإنسانية المعقدة والمتباينة إلى معادلات حسابية. هل يمكننا أن نتوقع من الروبوت أن يمتلك “تعاطفاً” أو “حساً أخلاقياً” بالمعنى البشري؟ من وجهة نظري، نحن كبشر، حتى مع كل تعقيداتنا، نجد صعوبة في مثل هذه القرارات، فكيف بالآلة؟ يجب أن نضع إطاراً أخلاقياً واضحاً، ليس فقط للتعامل مع هذه المعضلات، بل لتقبل فكرة أن الآلة قد تتصرف بطريقة لا تتوافق تماماً مع غريزتنا الإنسانية.

أطر العمل الأخلاقية: خارطة طريق للمستقبل

لحسن الحظ، أرى أن هناك جهوداً جادة على مستوى عالمي لوضع أطر عمل أخلاقية للذكاء الاصطناعي. هذه الأطر ليست مجرد توصيات، بل هي محاولات لوضع مبادئ توجيهية تساعد الشركات والحكومات على تطوير ونشر الذكاء الاصطناعي بشكل مسؤول. من ضمن هذه المبادئ الشفافية، المساءلة، الإنصاف، والأمان. شخصياً، أعتقد أن هذه المبادرات حيوية للغاية، فهي تمنحنا بعض الطمأنينة بأن هناك من يفكر في هذه التحديات بجدية. يجب أن تشمل هذه الأطر جميع أصحاب المصلحة: المطورين، المستخدمين، الحكومات، وحتى المنظمات غير الربحية. الأمر يتطلب حواراً مستمراً وتعاوناً دولياً، لضمان أن هذه الخارطة الأخلاقية تكون شاملة وقابلة للتطبيق في مختلف الثقافات والمجتمعات. لا يمكن لشركة واحدة أو دولة واحدة أن تحدد مستقبل أخلاقيات الروبوتات بمفردها.

| المبدأ الأخلاقي | الوصف | أهميته في الذكاء الاصطناعي |

|---|---|---|

| الشفافية | فهم كيفية عمل نظام الذكاء الاصطناعي واتخاذ قراراته. | بناء الثقة، كشف التحيزات، الامتثال القانوني. |

| المساءلة | تحديد الجهة المسؤولة عن الأضرار أو الأخطاء التي يسببها الذكاء الاصطناعي. | ضمان العدالة، تعويض المتضررين، تشجيع الابتكار المسؤول. |

| الإنصاف والعدالة | تجنب التمييز والتحيز وضمان معاملة جميع الأفراد بشكل متساوٍ. | حماية حقوق الإنسان، منع التداعيات الاجتماعية السلبية. |

| الأمان والموثوقية | ضمان عمل أنظمة الذكاء الاصطناعي بشكل آمن وموثوق به، وتجنب الأضرار. | حماية الأرواح والممتلكات، بناء ثقة المستخدمين. |

| الخصوصية | حماية البيانات الشخصية للمستخدمين من الوصول أو الاستخدام غير المصرح به. | الحفاظ على حقوق الأفراد، الامتثال للوائح حماية البيانات. |

بناء جسور الثقة: رحلتي الشخصية مع التكنولوجيا المسؤولة

من الشك إلى الاقتناع: لماذا أثق في الذكاء الاصطناعي المسؤول؟

في بداية رحلتي مع عالم الذكاء الاصطناعي والروبوتات، كنت مثل الكثيرين، يساورني الشك والقلق حيال هذه التقنيات. هل ستسلب منا وظائفنا؟ هل ستصبح قراراتنا بيد الآلة؟ هذه الأسئلة كانت تراودني باستمرار. لكن، بمرور الوقت، ومع متابعتي للجهود المبذولة نحو “الذكاء الاصطناعي المسؤول” و”الذكاء الاصطناعي الجدير بالثقة”، بدأت أرى بصيص أمل. عندما رأيت كيف أن الشركات الكبرى بدأت تلتزم بمبادئ أخلاقية واضحة، وكيف أن المنظمات الدولية تسعى لوضع معايير عالمية، شعرت أننا نسير في الاتجاه الصحيح. الأمر لا يتعلق بكون الذكاء الاصطناعي مثالياً، بل بكونه يتطور بوعي ومسؤولية، مع الأخذ في الاعتبار القيم الإنسانية. من تجربتي، هذه الشفافية والمساءلة هي التي تبني الثقة الحقيقية، وتجعلنا نتقبل هذه التقنيات كشريك وليس كتهديد.

دورنا كأفراد في تشكيل المستقبل

أصدقائي، لا تظنوا أن دورنا يقتصر على المراقبة فقط. نحن كأفراد، وكجزء من المجتمع الرقمي، لدينا قوة هائلة في تشكيل مستقبل هذه التقنيات. صوتنا مهم! عندما نطالب بالشفافية، وعندما ننتقد الممارسات غير الأخلاقية، فإننا نساهم في دفع الشركات والحكومات نحو مسار أكثر مسؤولية. كل تفاعل لنا، وكل رأي نعبر عنه على منصات التواصل الاجتماعي، يمكن أن يكون جزءاً من هذا التغيير الإيجابي. لا تستهينوا بقوتكم! يجب أن نكون مستخدمين واعين ومسؤولين، نفهم كيف تعمل هذه التقنيات، وما هي حقوقنا كأفراد. أنا شخصياً، أحاول دائماً أن أشارك تجاربي وآرائي بكل صدق وشفافية، لإيماني بأن الوعي هو الخطوة الأولى نحو بناء مستقبل رقمي أفضل وأكثر إنسانية.

الابتكار المسؤول: قصة نجاح أم حلم بعيد؟

التوازن الصعب بين السرعة والأخلاق

لطالما انبهرت بالسرعة المذهلة التي يتطور بها عالم الذكاء الاصطناعي. كل يوم نسمع عن ابتكارات جديدة تغير وجه حياتنا. لكن، في خضم هذا السباق المحموم، يبرز سؤال مهم: هل يمكننا تحقيق الابتكار بسرعة دون التضحية بالمسؤولية الأخلاقية؟ في كثير من الأحيان، أجد أن هناك توتراً بين الرغبة في إطلاق منتجات جديدة بسرعة وبين الحاجة للتأكد من أنها آمنة، عادلة، وأخلاقية. هذا التوازن ليس سهلاً أبداً، ويتطلب من الشركات استثماراً كبيراً في البحث والتطوير الأخلاقي، وليس فقط في التكنولوجيا بحد ذاتها. من واقع متابعتي، أرى أن الشركات التي تنجح في تحقيق هذا التوازن هي التي ستحظى بالاستمرارية والثقة على المدى الطويل، فالمستخدمون اليوم أصبحوا أكثر وعياً بالآثار الأخلاقية للتقنيات التي يستخدمونها.

أمثلة مضيئة: عندما تضع الشركات الأخلاق أولاً

بالرغم من التحديات، هناك أمثلة مشرقة لشركات تكنولوجية تبنت “الابتكار المسؤول” كفلسفة عمل. هذه الشركات لم تكتفِ بتطوير تقنيات متقدمة، بل وضعت أيضاً أطراً صارمة للحوكمة الأخلاقية، وعملت على تدريب فرقها على معايير الأخلاق في الذكاء الاصطناعي. لقد رأيت مبادرات حقيقية تهدف إلى الحد من التحيز في الخوارزميات، وتعزيز الشفافية، وضمان الخصوصية. هذه الشركات أدركت أن الاستثمار في الأخلاقيات ليس عبئاً، بل هو استثمار في المستقبل. عندما تتعاون الشركات مع الحكومات والجامعات والمنظمات غير الربحية، يمكننا أن نرى كيف يمكن للابتكار أن يخدم الإنسانية حقاً. هذا النوع من التعاون يبني منظومة متكاملة تضمن أن الذكاء الاصطناعي يوجه نحو الصالح العام، ويفتح آفاقاً جديدة للتطور التكنولوجي الذي يحترم قيمنا ويساهم في بناء مجتمعات أفضل.

المستقبل بين أيدينا: رؤية شخصية لتحديات وفرص

تحديات ثقافية واجتماعية تنتظرنا

لا أخفيكم سراً، المستقبل يحمل في طياته تحديات قد تبدو هائلة، خاصة في مجتمعاتنا العربية. فتقبل الروبوتات والذكاء الاصطناعي في حياتنا اليومية يثير أسئلة ثقافية واجتماعية عميقة. هل سنكون مستعدين لتقبل الروبوتات في بيوتنا، في مدارسنا، وحتى في المستشفيات لرعاية كبار السن؟ هذه ليست أسئلة تقنية بحتة، بل هي أسئلة تتعلق بهويتنا وقيمنا وكيف نرى مكان التكنولوجيا في نسيجنا الاجتماعي. من المهم جداً أن نبدأ هذا الحوار المجتمعي الآن، وأن نجهز أجيالنا القادمة للتعامل مع هذه التغيرات بوعي ومرونة. علينا أن نفكر في كيفية دمج هذه التقنيات بطريقة تعزز من قيمنا، ولا تتعارض معها. لقد لاحظت أن الوعي بهذه الجوانب الثقافية ضروري للغاية عند تصميم ونشر أي نظام ذكاء اصطناعي، خاصة في منطقة مثل منطقتنا ذات التنوع والغنى الثقافي.

فرص ذهبية تنتظر العقول المبدعة

مع كل هذه التحديات، أرى أيضاً فرصاً ذهبية تنتظر العقول المبدعة في عالمنا العربي. تخيلوا معي، القدرة على تطوير حلول ذكاء اصطناعي مخصصة لتلبية احتياجات مجتمعاتنا، تحترم ثقافتنا، وتتحدث لغتنا. هناك مجال واسع للابتكار في مجالات مثل التعليم، الرعاية الصحية، الزراعة، وحتى في حفظ تراثنا الغني. الشباب العربي اليوم لديه القدرة على أن يكون جزءاً أساسياً من هذه الثورة التكنولوجية، ليس فقط كمستهلكين، بل كمبتكرين وقادة. من خلال التركيز على التدريب وتنمية المهارات في مجال الذكاء الاصطناعي والأخلاقيات المرتبطة به، يمكننا بناء جيل قادر على المنافسة عالمياً، والمساهمة في بناء مستقبل أفضل لمنطقتنا. هذه ليست مجرد أمنيات، بل هي إمكانات حقيقية ألمسها في كل مرة أتحدث فيها مع شبابنا الطموح والمتحمس للتكنولوجيا.

الذكاء الاصطناعي وحماية خصوصيتنا: معركة الثقة

بياناتنا: كنز أم عبء؟

في عالم اليوم، أصبحت بياناتنا الشخصية هي الوقود الذي يغذي محركات الذكاء الاصطناعي. كل نقرة، كل بحث، كل صورة، كلها تُجمع وتُحلل لتجعل هذه الأنظمة “أذكى”. ولكن، هل فكرنا يوماً في الثمن؟ من تجربتي، أرى أن قضية الخصوصية هي إحدى أكبر المعارك الأخلاقية في عصر الذكاء الاصطناعي. فكيف نضمن أن هذه الشركات، التي تجمع كماً هائلاً من معلوماتنا، تحميها وتستخدمها بمسؤولية؟ متى يصبح جمع البيانات اختراقاً لخصوصيتنا؟ هذا التساؤل يلح عليّ باستمرار. يجب أن نطالب بحماية بياناتنا بصرامة، وأن تكون هناك قوانين واضحة ومطبقة تضمن عدم استخدام هذه البيانات بطرق تضر بنا أو بخصوصيتنا. لقد أظهرت العديد من الدراسات أن المخاوف بشأن الخصوصية تؤثر بشكل مباشر على ثقة المستخدمين في تقنيات الذكاء الاصطناعي، وهذا أمر لا يمكن الاستهانة به.

تحصين أنفسنا: خطوات عملية لحماية خصوصيتنا

لحماية خصوصيتنا في عصر الذكاء الاصطناعي، لا يكفي أن نعتمد فقط على الشركات والحكومات. يجب أن نأخذ زمام المبادرة بأنفسنا. أولاً، كن واعياً لما تشاركه على الإنترنت. كل معلومة تضعها هناك قد تُستخدم بطريقة ما. ثانياً، اقرأ سياسات الخصوصية، حتى لو بدت معقدة ومملة، ففهمها يمنحك القوة. ثالثاً، استخدم أدوات وتقنيات حماية الخصوصية المتاحة، مثل الشبكات الافتراضية الخاصة (VPN) وإعدادات الخصوصية في التطبيقات. رابعاً، لا تتردد في التساؤل والاحتجاج إذا شعرت أن خصوصيتك تُنتهك. كل صوت يطالب بالخصوصية هو خطوة نحو بناء منظومة رقمية أكثر أماناً لنا جميعاً. من المهم أن نتذكر أن التكنولوجيا أداة، ونحن من يقرر كيف تُستخدم هذه الأداة. لنكن حراس خصوصيتنا وندافع عنها بكل قوة.

في الختام

أصدقائي الأعزاء، لقد كانت رحلة شيقة ومثيرة تلك التي خضناها معًا اليوم في عالم أخلاقيات الروبوتات والذكاء الاصطناعي. من واقع تجربتي الشخصية، أدركت أن هذا ليس مجرد نقاش تقني، بل هو حديث عن قيمنا الإنسانية ومستقبل أبنائنا. يجب ألا ننسى أننا كبشر، لدينا القوة لتوجيه هذه التقنيات نحو الخير والازدهار. لنكن واعين ومسؤولين، ولنعمل معًا لبناء جسور الثقة في عالم يزداد تعقيدًا يومًا بعد يوم. فالطريق أمامنا طويل، لكننا بوعينا وتعاوننا قادرون على رسم ملامح مستقبل مشرق للجميع، مستقبل يحترم إنسانيتنا ويثري حياتنا.

معلومات قد تهمك

وعيك بالبيانات

تأكد دائمًا من فهمك لأنواع البيانات التي تشاركها مع التطبيقات والخدمات المختلفة، وكيفية استخدامها. قراءة سياسات الخصوصية، وإن كانت تبدو أحيانًا معقدة ومملة، هي خطوة أساسية لحماية نفسك وحقوقك الرقمية في عالمنا المتسارع. لا تستسلم للضغوط ولا تقبل بالمجهول، فمعرفة ما يحدث ببياناتك هي أول خطوة نحو الأمان.

تفعيل إعدادات الخصوصية

لا تتردد في تفعيل أقصى درجات الخصوصية المتاحة في هاتفك وتطبيقاتك وجميع الأجهزة الذكية التي تستخدمها. هذه الإعدادات موجودة لحمايتك ولتمنحك تحكمًا أكبر في معلوماتك الشخصية، واستخدامها بحكمة يقلل بشكل كبير من تعرض بياناتك للخطر أو الاستخدام غير المرغوب فيه. اعتبرها درعك الواقي في الفضاء الرقمي.

استخدام أدوات الحماية

فكر جديًا في استخدام أدوات مثل الشبكات الافتراضية الخاصة (VPN) للحفاظ على أمان تصفحك وإخفاء عنوان IP الخاص بك، مما يزيد من صعوبة تتبع نشاطك على الإنترنت. هذه الأدوات ليست ترفًا بل أصبحت ضرورة في زمن باتت فيه كل نقرة قابلة للمراقبة. استثمر في حمايتك الرقمية لتضمن راحة بالك.

المشاركة في الحوار

صوتك مهم ولديه تأثير حقيقي! شارك بآرائك ومخاوفك حول أخلاقيات الذكاء الاصطناعي مع أصدقائك، عائلتك، وحتى على منصات التواصل الاجتماعي. الضغط المجتمعي يلعب دورًا فعالًا ومحوريًا في دفع الشركات والحكومات نحو تبني ممارسات أكثر مسؤولية وشفافية. لا تستهن بقوة كلمتك، فالتغيير يبدأ منك.

التعلم المستمر

عالم الذكاء الاصطناعي يتطور بسرعة مذهلة، وكل يوم يحمل في طياته الجديد. خصص وقتًا مستمرًا للتعرف على آخر المستجدات في مجال التكنولوجيا وأخلاقياتها، فالمعرفة هي سلاحك الأقوى والأكثر فعالية في هذا العصر الرقمي المتغير. كلما زادت معرفتك، زادت قدرتك على التفاعل بوعي ومسؤولية مع هذه التقنيات.

أهم النقاط

لقد استعرضنا اليوم رحلة عميقة في عالم أخلاقيات الذكاء الاصطناعي والروبوتات، وتوصلنا إلى عدة محاور رئيسية لا يمكن تجاهلها في سعينا نحو مستقبل رقمي أكثر عدلاً وإنسانية. أولاً، تقع على عاتق شركات التكنولوجيا مسؤولية أخلاقية جسيمة تتجاوز مجرد تطوير الأدوات التقنية؛ فهم في حقيقة الأمر حراس لمستقبلنا ويجب أن يمتلكوا بوصلة أخلاقية واضحة وقوية توجه جميع ابتكاراتهم وقراراتهم الحاسمة. ثانيًا، الذكاء الاصطناعي، ورغم قدراته الهائلة والواعدة، ليس محايدًا بطبيعته؛ فهو يعكس ويضخم التحيزات الموجودة في البيانات الضخمة التي يتدرب عليها، مما يستدعي منا ضرورة تفكيك “الصندوق الأسود” لهذه الأنظمة عبر تعزيز الشفافية القصوى في خوارزمياته وبياناته. ثالثًا، معضلة القرارات الأخلاقية الصعبة التي قد تواجهها الروبوتات والأنظمة الذكية تفرض علينا جميعًا، كمجتمع دولي، وضع أطر عمل أخلاقية قوية وواضحة، تحدد بدقة كيف ينبغي للآلات أن تتصرف في المواقف الحرجة والتي تنطوي على خيارات معقدة. رابعًا، بناء جسور الثقة الراسخة مع هذه التقنيات المتقدمة يتطلب منا جميعًا، كأفراد ومجتمعات، أن نكون واعين ومشاركين بفاعلية في تشكيل مستقبلها، وأن نطالب باستمرار بالابتكار المسؤول الذي يوازن بذكاء بين السرعة الخارقة في التطور والحاجة الملحة للأخلاق والقيم الإنسانية. وأخيرًا، لا يمكننا بأي حال من الأحوال إغفال أهمية حماية خصوصيتنا الثمينة في هذا العصر الرقمي المتسارع، فهي كنز ثمين يجب علينا تحصينه بخطوات عملية ومطالبات مستمرة بحقوقنا الرقمية التي كفلتها لنا القوانين والتشريعات. هذه النقاط مجتمعة ترسم خارطة طريق واضحة لمستقبل نتمنى أن يكون أكثر عدالة وإنسانية وتقدمًا، وذلك بفضل توجيه الذكاء الاصطناعي نحو الصالح العام للبشرية جمعاء.

الأسئلة الشائعة (FAQ) 📖

س: هل ستفهم الروبوتات قيمنا وتقاليدنا العربية وكيف يمكننا ضمان ذلك؟

ج: هذا سؤال جوهري وكم مرة راودني هذا التفكير! عندما أتحدث عن الروبوتات والذكاء الاصطناعي، أول ما يخطر ببالي هو كيف يمكن لآلة أن تفهم تعقيدات “العيب” و”الحشمة” و”الكرم” في مجتمعاتنا العربية.

إن قيمنا ليست مجرد قواعد، بل هي مشاعر وعادات متأصلة في ثقافتنا منذ قرون. شخصيًا، أرى أن التحدي الأكبر يكمن في برمجة الذكاء الاصطناعي ليتعلم من تفاعلاتنا البشرية المتنوعة، لا أن يُبرمج على قواعد جامدة.

يعني، لا يمكننا أن نتوقع من نموذج ذكاء اصطناعي تم تدريبه بالكامل على بيانات غربية أن يفهم تلقائيًا حساسية “الضيف” أو أهمية “الجيرة” لدينا. الحل، في رأيي، يكمن في أن نكون جزءًا فاعلاً في تطوير هذه التقنيات.

يجب أن يشارك خبراء من مجتمعاتنا العربية في تصميم وتدريب هذه الأنظمة، لتضمين الفروق الدقيقة في لغتنا وعاداتنا الاجتماعية وحتى نبرة صوتنا التي قد تحمل معاني مختلفة.

أنا أؤمن بأننا بحاجة إلى “لمسة عربية” في تطوير هذه التكنولوجيا لكي تتمكن من فهمنا والتفاعل معنا بطريقة تحترم خصوصيتنا الثقافية وتغنيها، لا أن تتجاهلها.

س: من المسؤول عن الأخطاء التي ترتكبها الروبوتات أو أنظمة الذكاء الاصطناعي، وكيف تُحاسب؟

ج: هذا السؤال يثير قلقي كثيرًا ويذكرني دائمًا بالنقاشات الحادة التي تدور في المؤتمرات التقنية. تخيلوا معي، سيارة ذاتية القيادة تتسبب في حادث، أو نظام تشخيص طبي يعطي معلومة خاطئة، أو حتى روبوت خدمة عملاء يقدم نصيحة غير دقيقة.

من يتحمل المسؤولية هنا؟ هل هو المبرمج الذي كتب الكود؟ أم الشركة المصنعة التي أنتجت الروبوت؟ أم المستخدم الذي اتخذ قرارًا بناءً على توصية الآلة؟ في تجربتي، لا توجد إجابة بسيطة وواضحة بعد.

القانون في كثير من الدول لم يلحق بعد بالقفزة التكنولوجية الهائلة هذه، وما زلنا في مرحلة وضع الأطر التنظيمية. أنا شخصيًا، أعتقد أن المسؤولية يجب أن تكون مشتركة، مع التركيز الأكبر على الشركات المطورة والمصنعة.

فهم من يملكون القدرة على وضع معايير صارمة للاختبار والسلامة، وتضمين آليات واضحة لتحديد الأخطاء وتصحيحها. يجب أن يكون هناك نوع من “سجل المسؤولية” الذي يوضح من قام بأي تعديل أو تحديث.

الأمر معقد، لكن لابد من حلول تضمن العدالة وتحمي حقوق المتضررين.

س: كيف يمكننا حماية أنفسنا وأطفالنا من الآثار السلبية المحتملة للذكاء الاصطناعي؟

ج: هذا السؤال يلامس قلبي كوالد وكمتابع للتكنولوجيا. أرى أن الخوف من الذكاء الاصطناعي ليس هو الحل، بل الفهم والوعي هما مفتاح الحماية. أولاً، يجب أن نكون واقعيين ونفهم أن الذكاء الاصطناعي ليس شريرًا بطبيعته، بل هو أداة.

تمامًا مثل أي أداة، يمكن استخدامها للخير أو للضرر. بالنسبة لأطفالنا، أعتقد أن تعليمهم التفكير النقدي هو أهم درع لهم. لا يجب أن يقبلوا كل ما تقوله الآلة أو تعرضه شاشاتهم دون تدقيق.

علمهم أن يسألوا “لماذا؟” و”كيف؟” وأن يتحققوا من المعلومات. ثانيًا، يجب أن نضع حدودًا واضحة لاستخدام التكنولوجيا في حياتنا اليومية، وخصوصًا مع أطفالنا.

لا يمكن تركهم بلا رقابة أمام أجهزة يمكنها أن تعرضهم لمحتوى غير مناسب أو حتى محاولات تلاعب بالرأي العام. أخيرًا، كآباء ومربين، دورنا أن نكون قدوة في الاستخدام المسؤول للتكنولوجيا.

عندما يرانا أطفالنا نستخدم الذكاء الاصطناعي بوعي، سيتعلمون أن يفعلوا المثل. إنها رحلة تعلم مستمرة لنا ولهم، لكن الأهم هو أن نكون دومًا على دراية وخطوة للأمام.