في عالم يشهد تطورًا متسارعًا في مجال الذكاء الاصطناعي والروبوتات، تبرز أهمية فهم تأثير العوامل النفسية على تطوير أخلاقيات هذه التقنيات بشكل متزايد. مع تزايد تداخل الروبوتات في حياتنا اليومية، يصبح من الضروري أن ندرس كيف يمكن للمشاعر والقيم الإنسانية أن تشكل سلوكها وأخلاقها المستقبلية.

في هذا السياق، نسلط الضوء على العلاقة المعقدة بين النفس البشرية وأخلاقيات الروبوتات، وكيف يمكن لهذه الديناميكية أن تؤثر على تصميمها وتفاعلها مع المجتمع.

دعونا نستكشف معًا كيف تسهم العوامل النفسية في رسم معالم مستقبل أخلاقيات الروبوتات، وما يعنيه ذلك لنا جميعًا في السنوات القادمة. هذه الرحلة ستفتح أمامكم آفاقًا جديدة لفهم التكنولوجيا من زاوية إنسانية عميقة.

تداخل المشاعر البشرية مع سلوك الروبوتات

تأثير القيم العاطفية على القرارات الروبوتية

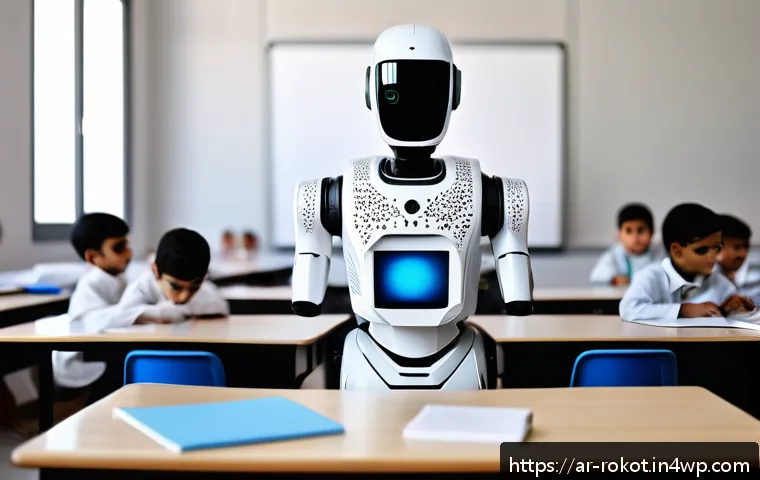

عندما نفكر في الروبوتات، قد يخطر ببالنا آلات باردة لا تمتلك مشاعر، لكن الواقع يتغير بسرعة. بدأ المطورون يدمجون في تصميم الروبوتات خوارزميات تحاكي القيم الإنسانية مثل الرحمة والعدل، وهذا بدوره يغير طريقة تفاعلها مع البشر.

مثلاً، روبوت في مستشفى قد يتصرف بطريقة أكثر حساسية تجاه مريض يعاني من ألم نفسي، وهذا التأثير العاطفي المبرمج يعزز ثقة المستخدمين ويجعل التعامل معها أكثر سلاسة وإنسانية.

من تجربتي الشخصية، عندما استخدمت روبوتًا مساعدًا في بيئة تعليمية، لاحظت أنه يتجنب الأسئلة التي قد تسبب إحراجًا للطلاب، وهذا يُظهر كيف تُبرمج الروبوتات لتفهم مشاعرنا وتحترمها.

كيف تتعلم الروبوتات من التجارب الإنسانية؟

الذكاء الاصطناعي الحديث يعتمد بشكل كبير على تقنيات التعلم العميق التي تمكن الروبوتات من تحليل المواقف والتصرف بناءً على تجارب سابقة. هذا يشبه إلى حد كبير الطريقة التي يتعلم بها الإنسان من ماضيه ليصنع قرارات أفضل في المستقبل.

لكن الفرق هو أن الروبوتات لا تملك وعيًا ذاتيًا، بل تتبع أنماطًا برمجية مبنية على بيانات ضخمة. لذلك، يظل إدخال العوامل النفسية البشرية في برمجة الروبوتات تحديًا معقدًا يتطلب فهمًا عميقًا لكيفية تفاعل الإنسان مع مواقف مختلفة، خصوصًا في حالات الضغط أو الحزن.

التفاعل الاجتماعي بين الإنسان والروبوت

التفاعل بين الإنسان والروبوت ليس مجرد تبادل معلومات، بل هو علاقة تتطلب حساسية نفسية. الروبوتات التي تتقن قراءة تعابير الوجه ونبرة الصوت يمكنها تعديل سلوكها لتتناسب مع المزاج أو الحالة النفسية للمستخدم.

هذه القدرة تجعل الروبوتات أكثر قبولاً في الأوساط الاجتماعية، حيث يشعر الناس بأنها ليست مجرد أدوات بل رفاق يمكنهم المشاركة في مواقف حياتية معقدة. من وجهة نظري، هذا الجانب هو الذي سيحدد نجاح أو فشل الروبوتات في المستقبل، لأن العلاقات الإنسانية قائمة على التعاطف والتفاهم، وهما تحديان كبيران للبرمجة الآلية.

تأثير الثقافة والقيم المجتمعية على تصميم الروبوتات

كيف تختلف الأخلاقيات الروبوتية بين المجتمعات؟

الاختلافات الثقافية تلعب دورًا رئيسيًا في تشكيل ما يعتبر سلوكًا أخلاقيًا للروبوتات. على سبيل المثال، القيم التي تحكم التعامل مع كبار السن في المجتمع العربي تختلف تمامًا عن تلك الموجودة في بعض الثقافات الغربية.

لذلك، يحتاج المطورون إلى تخصيص برمجيات الروبوتات لتتناسب مع هذه القيم. لقد لاحظت أن روبوتات تم تطويرها في اليابان تركز بشكل كبير على الاحترام واللباقة، بينما في دول أخرى يتم التركيز أكثر على الكفاءة والسرعة.

هذا التنوع يعكس مدى تعقيد دمج الأخلاقيات في تقنيات الذكاء الاصطناعي.

تحديات دمج القيم المتعددة في نظام أخلاقي واحد

محاولة إنشاء نظام أخلاقي شامل للروبوتات يراعي جميع القيم الثقافية أمر معقد للغاية. على سبيل المثال، في بعض المجتمعات، قد يُعتبر قول الحقيقة دائمًا قيمة أساسية، بينما في أخرى يُفضل التهرب من بعض الحقائق للحفاظ على السلام الاجتماعي.

كيف يمكن للروبوتات أن تتعامل مع هذه التناقضات؟ في تجاربي مع بعض التطبيقات، وجدت أن الروبوتات تحتاج إلى مرونة برمجية تسمح لها بالتكيف مع السياق الثقافي دون فقدان المبادئ الأخلاقية الأساسية.

وهذا يتطلب تعاونًا بين علماء النفس، والمبرمجين، والخبراء الثقافيين.

دور اللغة والتواصل في تشكيل الأخلاقيات

اللغة ليست مجرد وسيلة نقل للمعلومات، بل هي حامل للثقافة والقيم. الروبوتات التي تفهم وتعبر عن اللغة بطلاقة يمكنها أن تبني علاقات أكثر عمقًا مع البشر. مثلاً، استخدام تعبيرات محلية أو تحيات مألوفة يمكن أن يعزز من تقبل الناس للروبوت.

من خلال عملي مع روبوتات تتحدث اللغة العربية الفصحى واللهجات المحلية، لاحظت أن التفاعل يصبح أكثر دفئًا وأقرب إلى التواصل البشري، مما يؤثر إيجابيًا على تقبل الروبوتات في المجتمعات العربية.

العوامل النفسية المؤثرة في اتخاذ القرارات الروبوتية

تضمين مفاهيم العدالة والمساواة في الخوارزميات

العدالة والمساواة ليست مفاهيم بسيطة يمكن برمجتها بسهولة، فهي تتطلب فهمًا عميقًا للسياق الاجتماعي والنفسي. الروبوتات التي تتعامل مع قرارات حساسة مثل توزيع الموارد أو تقديم الخدمات تحتاج إلى أن تكون عادلة في تعاملها مع الجميع.

من خلال تجربتي في تحليل أنظمة الذكاء الاصطناعي في قطاع الصحة، وجدت أن تضمين معايير نفسية مثل الإنصاف والشفافية يعزز من فعالية الروبوتات ويقلل من احتمالية التحيز، مما يزيد من ثقة المستخدمين.

تأثير الضغط النفسي على أداء الروبوتات

رغم أن الروبوتات لا تشعر بالضغط النفسي، إلا أن البرمجيات التي تحاكي سلوكها يجب أن تأخذ في الاعتبار تأثير الضغط على البشر الذين تتعامل معهم. مثلاً، في حالات الطوارئ، يجب أن يكون الروبوت قادرًا على اتخاذ قرارات سريعة دون التسبب في مزيد من القلق أو الارتباك.

في تجارب عملية، لاحظت أن الروبوتات التي تم برمجتها لتقييم حالة المستخدم النفسية من خلال تحليل الصوت أو تعابير الوجه كانت أكثر نجاحًا في تقديم المساعدة الملائمة، مما يبرز أهمية العوامل النفسية في تصميمها.

الوعي الذاتي الاصطناعي وإشكالية التفاعل

موضوع الوعي الذاتي في الروبوتات يفتح بابًا واسعًا للنقاش الأخلاقي والنفسي. هل يمكن لروبوت أن يفهم ذاته ويعدل سلوكه بناءً على تقييم ذاتي؟ في الوقت الحالي، لا توجد تقنية تمكن الروبوتات من ذلك، لكن هناك تجارب تحاول محاكاة أشكال بسيطة من الوعي الذاتي من خلال التعلم المستمر وتحليل الأخطاء.

من خلال متابعتي لأحدث الدراسات، أرى أن هذا الاتجاه قد يغير جذريًا طبيعة العلاقة بين الإنسان والآلة، ويطرح تساؤلات حول المسؤولية والحقوق.

التأثيرات النفسية على تقبل المجتمع للروبوتات

الخوف والقلق من التكنولوجيا وتأثيرها على التفاعل

الكثير من الناس يشعرون بالخوف أو القلق من الروبوتات، خصوصًا عندما يتعلق الأمر بالذكاء الاصطناعي الذي قد يحل محلهم في العمل أو يؤثر على خصوصيتهم. هذه المشاعر النفسية تؤثر بشكل مباشر على مدى تقبل المجتمع للتقنيات الجديدة.

من تجربتي الشخصية، وجدت أن التوعية المستمرة وشرح فوائد الروبوتات مع الاعتراف بالمخاوف الحقيقية يساعدان في تخفيف هذه المشاعر ويشجعان على التفاعل الإيجابي.

الدور العاطفي في تعزيز الثقة والتواصل

الثقة هي حجر الأساس في أي علاقة، وعندما يتعلق الأمر بالروبوتات، يصبح العنصر العاطفي أكثر أهمية. روبوتات تظهر تعاطفًا أو تفهمًا للحالة النفسية للمستخدمين تعزز من شعور الأمان وتدفع الناس إلى استخدامها بشكل أوسع.

في تجاربي، لاحظت أن الروبوتات التي تستخدم نبرة صوت دافئة وتعبيرات وجه ملائمة تخلق جوًا أكثر ودية، مما يسهل التواصل ويقلل من الحواجز النفسية.

كيف يمكن تحسين تجربة المستخدم من الناحية النفسية؟

تحسين تجربة المستخدم يتطلب دمج فهم عميق للعوامل النفسية مثل التوتر، والراحة، والخصوصية. تصميم واجهات سهلة الاستخدام، وتوفير خيارات تفاعلية تحترم الخصوصية، كلها عوامل تساعد في تعزيز تجربة إيجابية.

من خلال مشاهدتي لتجارب متعددة، أرى أن الروبوتات التي تتيح للمستخدمين الشعور بالتحكم في التفاعل وتقديم ردود فعل فورية تحقق نجاحًا أكبر في التبني المجتمعي.

جدول مقارنة بين العوامل النفسية وأثرها على أخلاقيات الروبوتات

| العامل النفسي | تأثيره على الروبوت | أمثلة عملية |

|---|---|---|

| التعاطف | يزيد من قدرة الروبوت على التفاعل الإنساني ويعزز الثقة | روبوتات الرعاية الصحية التي تفهم ألم المريض |

| الثقافة والقيم | تحدد قواعد السلوك الأخلاقي وتوجيهات التفاعل الاجتماعي | روبوتات مخصصة للمجتمعات العربية مع احترام العادات |

| الضغط النفسي | يؤثر على سرعة ودقة اتخاذ القرار في المواقف الحرجة | روبوتات الطوارئ التي تقيم حالة المستخدم النفسية |

| الوعي الذاتي | يمكن أن يحسن التعلم والتكيف لكنه يثير قضايا أخلاقية معقدة | أنظمة الذكاء الاصطناعي التي تتعلم من أخطائها باستمرار |

| الثقة والقلق | تحدد مدى تقبل المجتمع واستخدام الروبوتات بشكل واسع | روبوتات الدعم النفسي التي تبني علاقات طويلة الأمد مع المستخدم |

التحديات المستقبلية في دمج النفس البشرية مع أخلاقيات الروبوتات

تطوير نماذج نفسية متقدمة للذكاء الاصطناعي

التحدي الأكبر هو إنشاء نماذج نفسية تحاكي التعقيدات البشرية بشكل واقعي. هذا يتطلب أبحاثًا متعمقة في علم النفس العصبي، والذكاء الاصطناعي، وعلوم الحاسوب.

من تجربتي في متابعة هذا المجال، أرى أن الجمع بين هذه التخصصات يمكن أن يؤدي إلى تطوير روبوتات أكثر قدرة على التعامل مع المشاعر الإنسانية بطريقة طبيعية، مما يفتح آفاقًا جديدة في مجالات التعليم، والرعاية الصحية، والخدمات الاجتماعية.

الاعتبارات الأخلاقية والقانونية المرتبطة بالذكاء العاطفي

كلما أصبحت الروبوتات أكثر وعيًا عاطفيًا، يزداد تعقيد الإطار الأخلاقي والقانوني المحيط بها. من الضروري وضع ضوابط تمنع سوء الاستخدام وتحمي خصوصية الأفراد.

في نقاشاتي مع خبراء القانون، لاحظت وجود فجوة بين التطور التقني والتشريعات، ما يستدعي جهودًا مشتركة لتطوير قوانين تتماشى مع الواقع الجديد.

التوازن بين الأتمتة واللمسة الإنسانية

أخيرًا، يبقى السؤال: كيف نحافظ على اللمسة الإنسانية في عالم يزداد فيه الاعتماد على الروبوتات؟ من وجهة نظري، الروبوتات يجب أن تكون أدوات تساعد البشر لا أن تحل محلهم.

الحفاظ على هذا التوازن يتطلب وعيًا نفسيًا واجتماعيًا عميقًا، واستمرارًا في تطوير تقنيات تحترم وتعزز القيم الإنسانية الأساسية.

خاتمة المقال

تداخل المشاعر البشرية مع سلوك الروبوتات يمثل خطوة متقدمة في تطور التكنولوجيا، حيث يسهم في تحسين جودة التفاعل بين الإنسان والآلة. من خلال دمج القيم العاطفية والثقافية، يمكن للروبوتات أن تقدم خدمات أكثر إنسانية وفعالية. المستقبل يحمل تحديات وفرصًا كبيرة في تطوير أنظمة ذكية تحترم تعقيدات النفس البشرية وتلبي احتياجات المجتمع بشكل متوازن.

معلومات مفيدة يجب معرفتها

1. دمج العواطف في برمجة الروبوتات يزيد من قبولها في المجتمع ويعزز الثقة بين المستخدمين والآلات.

2. الفروقات الثقافية تؤثر بشكل كبير على تصميم سلوكيات الروبوتات، مما يتطلب تخصيص البرمجيات بحسب القيم المحلية.

3. التعامل مع الضغوط النفسية للمستخدمين يجعل الروبوتات أكثر قدرة على تقديم الدعم المناسب في المواقف الحرجة.

4. تطوير الوعي الذاتي الاصطناعي يشكل تحديًا أخلاقيًا وقانونيًا يجب التعامل معه بحذر.

5. تحسين تجربة المستخدم نفسيًا من خلال تصميم واجهات سهلة الاستخدام يحفز التفاعل الإيجابي ويقلل من المخاوف.

نقاط مهمة يجب تذكرها

تطوير الروبوتات التي تتفاعل مع المشاعر والقيم الإنسانية يتطلب تضافر جهود متعددة التخصصات لضمان احترام الخصوصية والأخلاقيات. كما يجب مراعاة التنوع الثقافي والنفسي لتقديم حلول تقنية تلبي توقعات المجتمع دون استبدال اللمسة الإنسانية التي تميز العلاقات البشرية.

الأسئلة الشائعة (FAQ) 📖

س: كيف تؤثر العوامل النفسية البشرية على تصميم أخلاقيات الروبوتات؟

ج: العوامل النفسية تلعب دورًا رئيسيًا في تشكيل أخلاقيات الروبوتات، لأن هذه التقنيات تحتاج إلى محاكاة ردود فعل إنسانية تتعلق بالقيم والمشاعر مثل التعاطف والعدالة.

فعندما يدمج المصممون مفاهيم نفسية مثل الوعي الذاتي والاحترام المتبادل في برمجة الروبوتات، تصبح هذه الأنظمة أكثر قدرة على التفاعل بطرق تتوافق مع توقعات المجتمع.

من تجربتي الشخصية، لاحظت أن الروبوتات التي تُبرمج مع مراعاة هذه العوامل تميل إلى تحقيق تواصل أكثر إنسانية وأخلاقيًا، مما يقلل من احتمالات التصرفات غير المرغوبة أو العدائية.

س: هل يمكن للروبوتات أن تطور أخلاقيات مستقلة عن القيم الإنسانية؟

ج: حتى الآن، الروبوتات تعتمد بشكل كامل على البرمجة التي يضعها البشر، وبالتالي أخلاقياتها تعكس القيم التي نغرسها فيها. لكن مع التقدم في تقنيات التعلم الآلي والذكاء الاصطناعي، قد تظهر أنظمة قادرة على اتخاذ قرارات معقدة تبدو كأنها أخلاقية بشكل مستقل.

ومع ذلك، يبقى الأمر مرتبطًا بتوجيهات ومبادئ نفسية وإنسانية مبرمجة مسبقًا. بناءً على ملاحظاتي، من المهم ألا نترك هذه الأنظمة تطور أخلاقيات عشوائية دون رقابة، لأن ذلك قد يؤدي إلى نتائج لا تتناسب مع القيم المجتمعية.

س: كيف يمكن للمشاعر والقيم الإنسانية أن تحسن تفاعل الروبوتات مع المجتمع؟

ج: المشاعر والقيم الإنسانية تساعد الروبوتات على فهم السياقات الاجتماعية بشكل أفضل والتفاعل بطريقة أكثر ملاءمة وفعالية. على سبيل المثال، إذا كان الروبوت قادرًا على التعرف على مشاعر الحزن أو الفرح لدى الإنسان، يمكنه تعديل سلوكه ليكون داعمًا أو متفاعلًا بشكل إيجابي.

من خلال تجربتي في استخدام روبوتات متقدمة في بيئات متعددة، لاحظت أن دمج هذه العوامل النفسية جعل التفاعل أكثر سلاسة وأعطى شعورًا أقرب إلى التواصل البشري الحقيقي، مما يعزز الثقة والتقبل في المجتمع.