يا أصدقائي الأعزاء ومتابعي مدونتي الكرام، هل توقفتم يومًا لتفكروا في كيفية اتخاذ الآلات لقراراتها؟ لقد أصبحت الروبوتات والذكاء الاصطناعي جزءًا لا يتجزأ من حياتنا، من السيارات ذاتية القيادة إلى المساعدين الرقميين، ولم يعد الأمر مجرد خيال علمي بل حقيقة ملموسة تثير الكثير من التساؤلات العميقة.

لطالما شغفني الفضول حول النقطة الجوهرية التي تتقاطع فيها التكنولوجيا مع الأخلاق، خاصة عندما تواجه هذه الأنظمة الذكية مواقف تتطلب أحكامًا معقدة وسريعة.

فهل يمكننا حقًا برمجة “ضمير” رقمي؟ وما هي الأسس التي تعتمد عليها هذه الآلات لتحديد الصواب والخطأ في عالمنا المعقد؟ هذا السؤال ليس أكاديميًا فحسب، بل هو مفتاح لمستقبل تعايشنا مع هذه الكيانات الذكية.

في هذا المقال، سأكشف لكم الأبعاد الخفية لآليات اتخاذ القرار الأخلاقي في الروبوتات، وسنغوص معًا في تفاصيلها المثيرة التي ستغير نظرتكم تمامًا!

كيف نتعلم نحن.. وكيف تتعلم الآلة؟

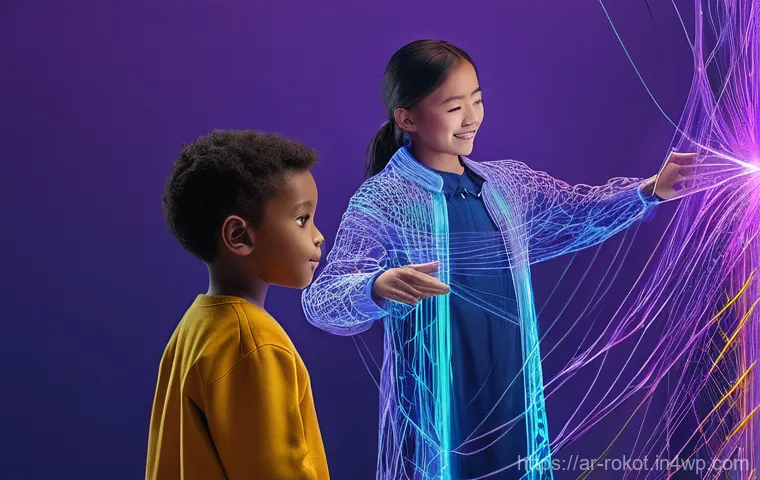

يا أصدقائي، هل فكرتم يومًا كيف يتشكل ضميرنا نحن كبشر؟ الأمر يبدأ من الطفولة، من القصص التي يرويها آباؤنا، ومن التجارب التي نمر بها، ومن القيم التي يغرسها المجتمع فينا. نحن نتعلم الصواب والخطأ من خلال التفاعل، الخطأ والصواب، الفرح والألم. لكن كيف يمكن لآلة لا تملك مشاعر أن تفهم كل هذا؟ هذا هو التحدي الأكبر! البرمجة وحدها لا تكفي، فالأمر يتعدى مجرد إعطاء أوامر. إننا نتحدث عن غرس قيم معقدة في أنظمة لا تدرك الوجود بمعناه البشري. الأمر يشبه محاولة تعليم طفل صغير عن تعقيدات الفلسفة الأخلاقية باستخدام قائمة من القواعد الجافة. من خلال تجربتي مع استكشاف عالم الذكاء الاصطناعي، وجدت أن المطورين يبذلون جهودًا جبارة لتقليد هذه العملية البشرية المعقدة. إنهم لا يبرمجون الروبوت ليفعل “الصواب” فقط، بل يبرمجونه لـ “يتعلم” الصواب، وهذا فرق كبير. هذا التعلم يشمل تحليل كميات هائلة من البيانات الأخلاقية، وفهم السياقات المختلفة، وحتى محاولة التنبؤ بالعواقب، تمامًا كما نفعل نحن حين نفكر مليًا قبل اتخاذ قرار مهم. إنه مسعى نبيل ومحير في آن واحد يجعلني أتعجب من براعة العقل البشري وقدرته على محاكاة نفسه.

الذكاء الاصطناعي: محاكاة الفضيلة أم مجرد قواعد؟

في البداية، كنت أعتقد أن الأمر كله مجرد خوارزميات، مجموعة من “إذا حدث كذا، فافعل كذا”. ولكن بعد تعمقي في هذا المجال، أدركت أن الموضوع أعمق بكثير وأكثر تشابكًا. إنهم يحاولون بناء أنظمة يمكنها محاكاة الفضيلة، لا مجرد اتباع القواعد بشكل أعمى. هذا يعني أن الروبوت يجب أن يكون قادرًا على التعامل مع المواقف الرمادية، التي لا يوجد فيها أبيض وأسود واضحان. على سبيل المثال، إذا كان الروبوت في سيارة ذاتية القيادة وواجه موقفًا حرجًا، فهل يجب أن يختار حماية ركابه بأي ثمن، أم يقلل الضرر العام حتى لو تعرض الركاب للخطر؟ هذه ليست أسئلة لها إجابات سهلة ومباشرة، وهي تتطلب أكثر من مجرد قائمة من الأوامر المبرمجة مسبقًا. إنها تتطلب نوعًا من “الفهم” للسياق الأخلاقي المعقد، وهذا ما يجعل هذا المجال مثيرًا ومخيفًا في نفس الوقت. أعتقد أننا لا زلنا في المراحل الأولى من فهم كيف يمكن للآلات أن تتخذ قرارات “أخلاقية” حقًا بمستوى يرقى للمستوى البشري.

التعلم المعزز والأخلاق: هل يمكن للآلة أن “تتوب”؟

من أروع التقنيات التي رأيتها في هذا المجال هو “التعلم المعزز”. تخيلوا أن الآلة تتعلم من أخطائها، تمامًا مثلما يتعلم الطفل عندما يلمس شيئًا ساخنًا ويتألم، فيبتعد عنه في المرة القادمة. في عالم الأخلاق الآلية، هذا يعني أن الروبوت يتلقى “مكافآت” على القرارات الأخلاقية الجيدة و”عقوبات” على القرارات السيئة. ولكن هنا يكمن السؤال المحير: هل هذا يعني أن الآلة “تتوب” أو “تندم” على فعل خاطئ؟ بالطبع لا بالمعنى البشري الذي نعرفه ونحس به. لكنها تعدل سلوكها لتحقيق أهداف أخلاقية محددة مسبقًا بطريقة محسوبة. هذه العملية تشبه إلى حد كبير كيف نصقل سلوكياتنا بمرور الوقت بناءً على ردود الفعل من البيئة المحيطة بنا. الفارق الجوهري هو أننا نملك مشاعر وعواطف، بينما هي تملك خوارزميات ومعادلات رياضية معقدة. ومع ذلك، فإن القدرة على التعلم والتكيف هي خطوة ضخمة نحو بناء أنظمة ذكية يمكنها التصرف بطريقة تتوافق مع قيمنا الأخلاقية، وهو أمر لم أكن لأتخيله قبل سنوات قليلة مضت، ويثير في نفسي الكثير من التساؤلات حول المستقبل.

القيم الإنسانية في لغة الآلة: تحدي الترجمة

يا أحبابي، ربما تكونون قد سمعتم عن “مشكلة العربة” الشهيرة في الفلسفة الأخلاقية. إنها معضلة افتراضية تُستخدم لاختبار مدى التزامنا بمبادئ أخلاقية معينة. تخيلوا لو أن ذكاءً اصطناعيًا وجد نفسه أمام هذا الموقف الحرج، حيث يجب عليه اتخاذ قرار مصيري في جزء من الثانية. كيف سيترجم القيم الإنسانية المعقدة مثل “قيمة الحياة”، “المسؤولية”، “تقليل الضرر” إلى لغة برمجية مفهومة ومحسوبة؟ الأمر ليس سهلاً على الإطلاق. فنحن كبشر، قد نختلف حول الحل الأمثل لهذه المعضلة، وقد ندخل في نقاشات طويلة دون الوصول لقرار قاطع، فما بالكم بآلة مبرمجة! هذه القصة تذكرني دائمًا بمدى صعوبة “ترجمة” الفروق الدقيقة في أخلاقنا إلى معادلات رقمية صلبة. لا يتعلق الأمر فقط بترجمة الكلمات، بل بترجمة المعاني العميقة والظلال الرمادية التي تشكل جوهر اتخاذ قراراتنا الأخلاقية. في عالمنا العربي، لدينا قيمنا الخاصة وتقاليدنا التي قد تختلف عن ثقافات أخرى، فكيف يمكن للذكاء الاصطناعي أن يستوعب هذا التنوع ويحترمه؟ هذا ما يجعل الأمر أكثر تعقيدًا وإثارة في نفس الوقت. لقد رأيت بعيني كيف أن بعض الأنظمة لا تستطيع فهم السياق الثقافي، وتتصرف بطرق تبدو لنا غريبة أو غير لائقة أحيانًا، وهذا يؤكد على أهمية البحث الدؤوب في هذا المجال.

| النموذج الأخلاقي | الفكرة الأساسية | مثال تطبيقي في الذكاء الاصطناعي |

|---|---|---|

| الأخلاق النفعية (Utilitarianism) | اختيار الفعل الذي يحقق أكبر قدر من الخير لأكبر عدد من الناس، مع تقليل الضرر قدر الإمكان. | سيارة ذاتية القيادة تختار مسارًا يقلل عدد الإصابات المحتملة في حادث وشيك، حتى لو كان ذلك يعني التضحية بالركاب لإنقاذ مشاة أكثر، لأن النتيجة الكلية هي إنقاذ المزيد من الأرواح. |

| الأخلاق الواجبة (Deontology) | اتباع مجموعة من القواعد والمبادئ الأخلاقية الصارمة بغض النظر عن النتائج المحتملة. | روبوتات المستشفيات تتبع بروتوكولات صارمة لخصوصية المريض وسلامته، ولا تتخذ قرارات بناءً على نتائج متوقعة فقط، بل تلتزم بالقواعد الموضوعة لحماية البيانات وعدم إلحاق الضرر. |

| أخلاق الفضيلة (Virtue Ethics) | التركيز على تطوير “صفات” أخلاقية مرغوبة في الذكاء الاصطناعي مثل العدالة، الشفافية، والمسؤولية. | تصميم نظام ذكاء اصطناعي للتوظيف يهدف إلى أن يكون “عادلاً” و”غير متحيز” في تقييم المرشحين بناءً على ميزات معينة فقط، متجنبًا أي شكل من أشكال التمييز. |

نماذج أخلاقية للذكاء الاصطناعي: بوصلة بلا قلب؟

هناك العديد من النماذج الأخلاقية التي يحاول المطورون تطبيقها على الذكاء الاصطناعي لجعل قراراته أكثر قربًا من القيم البشرية. بعضهم يعتمد على “الأخلاق النفعية”، حيث يختار الذكاء الاصطناعي المسار الذي يحقق أكبر قدر من الخير لأكبر عدد من الناس، وهذا يعني دائمًا حساب النتائج. والبعض الآخر يميل إلى “الأخلاق الواجبة”، حيث يتبع الذكاء الاصطناعي مجموعة محددة من القواعد والمبادئ بغض النظر عن النتائج، كأنه يلتزم بـ “قوانين” لا يحيد عنها. وهناك أيضًا من يحاول دمج “أخلاق الفضيلة”، التي تركز على تطوير صفات معينة في الذكاء الاصطناعي مثل “العدل” و”الشفافية” و”النزاهة”. هذه النماذج توفر بوصلة للذكاء الاصطناعي، لكنها تفتقر إلى “القلب” البشري الذي يشعر بالتعاطف والحيرة والندم. شخصيًا، أرى أن الجمع بين هذه النماذج، مع التركيز الشديد على الشفافية وقابلية التفسير، هو السبيل الوحيد لجعل الذكاء الاصطناعي يتخذ قرارات يمكننا الوثوق بها والتعايش معها. لقد شهدت بنفسي بعض التجارب التي فشلت فشلاً ذريعًا لأنها ركزت على جانب واحد فقط من هذه النماذج، مما أدى إلى نتائج غير متوقعة ومربكة، وهذا يدفعني دائمًا للتفكير في أهمية التوازن.

أخلاقيات البيانات: أساس الضمير الرقمي

لا يمكننا الحديث عن الأخلاق في الذكاء الاصطناعي دون التطرق إلى أخلاقيات البيانات، فهي الأساس الذي يبنى عليه كل شيء. البيانات هي الوقود الذي يشغل هذه الأنظمة ويجعلها تعمل، وإذا كانت هذه البيانات متحيزة أو غير عادلة أو غير ممثلة للمجتمع، فإن القرارات الأخلاقية للذكاء الاصطناعي ستكون كذلك حتمًا. تخيلوا لو أن نظامًا للتعرف على الوجه تم تدريبه على بيانات تحتوي على عدد قليل جدًا من الصور لأشخاص من جنسيات أو ألوان بشرة معينة. هل سيكون هذا النظام عادلاً ودقيقًا في قراراته عند تطبيقه على مجموعة واسعة من الناس؟ بالتأكيد لا! لقد تابعت الكثير من القصص المحزنة والمقلقة حول أنظمة ذكاء اصطناعي اتخذت قرارات تمييزية أو خاطئة بسبب البيانات المتحيزة التي دربت عليها. هذا يؤكد لي أن بناء “ضمير رقمي” حقيقي وموثوق يبدأ من المصدر نفسه: جودة البيانات ونزاهتها. يجب أن نكون يقظين للغاية لضمان أن البيانات التي نستخدمها لتدريب هذه الأنظمة تعكس تنوع عالمنا وقيمنا الأخلاقية بأمانة وحيادية تامة. إنها مسؤولية ضخمة تقع على عاتق المطورين والباحثين، ويجب علينا جميعًا أن نكون جزءًا من مراقبتها والتدقيق فيها.

المسؤولية الأخلاقية: من يتحمل العبء؟

عندما يتخذ الروبوت قرارًا كارثيًا، أو عندما يخطئ الذكاء الاصطناعي في تقدير موقف ما، من المسؤول في نهاية المطاف؟ هل هو المبرمج الذي كتب الكود؟ أم الشركة المصنعة التي قامت بتجميعه وتسويقه؟ أم المستخدم الذي قام بتشغيله أو سمح له بالعمل؟ هذا السؤال يعقد الأمور كثيرًا، ويجعلني أفكر مليًا في التحديات القانونية والأخلاقية التي تنتظرنا في المستقبل القريب. الأمر ليس كالخطأ البشري الذي يمكن أن يُنسب إلى فرد معين بشكل مباشر. هنا، نحن نتحدث عن نظام معقد يتخذ قرارات بناءً على خوارزميات وبرمجيات تم تصميمها من قبل فريق كامل من المهندسين، وربما تعلمت من بيانات ضخمة ومعقدة. تخيلوا معي، سيارة ذاتية القيادة تتسبب في حادث غير متوقع. هل نلوم السيارة نفسها باعتبارها كيانًا مستقلاً؟ أم مهندس البرمجيات الذي كتب الكود الأساسي؟ أم الشركة التي صنعتها وباعتها؟ هذا يدفعنا إلى إعادة التفكير في مفهوم “المسؤولية” بأكمله في عصر الذكاء الاصطناعي. من وجهة نظري، يجب أن يكون هناك إطار قانوني واضح يحدد هذه المسؤوليات بدقة، لكي نتمكن من محاسبة الأطراف المعنية وضمان الشفافية والعدالة. لقد شاركت في العديد من النقاشات حول هذا الموضوع، وكل مرة أخرج منها بحيرة أكبر حول تعقيداته الفائقة. لكن الأكيد هو أننا لا نستطيع ترك الأمور للصدفة أو للتفسيرات الفردية.

هل نحتاج لقوانين روبوتات؟

بصراحة، نعم! أظن أننا في أمس الحاجة إلى وضع قوانين واضحة ومحددة لعمل الروبوتات والذكاء الاصطناعي في جميع جوانب حياتنا. ليس فقط لتحديد المسؤولية عند وقوع الأخطاء أو الكوارث، بل أيضًا لوضع حدود أخلاقية لما يمكن لهذه الأنظمة أن تفعله وما لا يمكنها. فكروا في قوانين المرور التي تنظم حركة السيارات وتضمن سلامة الجميع في الشوارع. نحن نحتاج لشيء مماثل للذكاء الاصطناعي لتنظيم سلوكه وتأثيره على المجتمع. هذه القوانين يجب أن تكون عالمية قدر الإمكان لتحقيق التناسق، ولكنها أيضًا يجب أن تراعي الفروق الثقافية والقيم المحلية لكل مجتمع. لقد قرأت مؤخرًا عن مبادرات قوية في الاتحاد الأوروبي لوضع “ميثاق أخلاقي” شامل للذكاء الاصطناعي، وهذا ما نحتاجه تمامًا في مناطقنا أيضًا. يجب أن لا ننتظر حتى تقع الكوارث الكبرى لنتحرك ونبدأ في التفكير. الوقاية خير من العلاج، وهذا ينطبق تمامًا على هذا المجال الحساس. يجب أن نعمل معًا، كمجتمعات عالمية، لتشكيل هذه القوانين التي ستحمي مستقبلنا المشترك مع هذه التقنيات المذهلة. هذا ما أتمناه وأدعو إليه دائمًا في حديثي مع المطورين والمهتمين بهذا الشأن.

الشفافية وقابلية التفسير: مفتاح الثقة

من أهم الجوانب التي يجب أن نركز عليها بشكل كبير هي الشفافية المطلقة وقابلية تفسير قرارات الذكاء الاصطناعي. إذا اتخذت آلة قرارًا، سواء كان كبيرًا أو صغيرًا، يجب أن نكون قادرين على فهم كيف وصلت إلى هذا القرار، وما هي العوامل التي أثرت فيه. الأمر أشبه بطلب شرح من طفل لماذا فعل شيئًا معينًا. إذا قال: “لا أعرف”، فلن نثق به تمامًا ولن نطمئن إليه. نفس الشيء ينطبق على الذكاء الاصطناعي. إذا كانت قراراته مجرد “صندوق أسود” لا يمكن فهم آلياته الداخلية، فكيف يمكننا الوثوق به في مواقف حرجة أو مصيرية؟ هذا هو السبب في أنني أؤكد دائمًا على ضرورة تطوير أنظمة ذكاء اصطناعي “قابلة للتفسير” وواضحة المنطق. هذا لا يعني بالضرورة أن نفهم كل سطر كود برمجي، بل أن نفهم المنطق العام والاعتبارات وراء القرار المتخذ. عندما تعمل الآلة بشفافية، فإنها تبني جسرًا من الثقة العميقة بينها وبين المستخدمين، وهذا أمر لا يُقدر بثمن في رأيي وفي بناء علاقة قوية مع هذه التقنيات. لقد شعرت شخصيًا بالارتياح والاطمئنان عندما تعاملت مع أنظمة توفر شرحًا واضحًا لقراراتها، فهذا يعطيني إحساسًا بالتحكم والفهم، بدلاً من مجرد تقبل ما تقرره الآلة بشكل أعمى ودون سابق معرفة.

هل يمكن للروبوتات أن “تشعر” بالذنب؟

سؤال يطرح نفسه بقوة، أليس كذلك؟ عندما نتحدث عن القرارات الأخلاقية، فإن مفهوم “الذنب” غالبًا ما يكون جزءًا لا يتجزأ من المعادلة البشرية. نحن نشعر بالذنب عندما نرتكب خطأ، وهذا الشعور غالبًا ما يقودنا إلى التعلم وتصحيح سلوكنا في المستقبل وتجنب تكرار الخطأ. لكن هل يمكن لآلة أن تختبر هذا الشعور المعقد؟ بالطبع لا بالمعنى البيولوجي والنفسي الذي نختبره نحن كبشر. الروبوتات والذكاء الاصطناعي لا تملك أجهزة عصبية أو مراكز للمشاعر والعواطف. ومع ذلك، يمكن تصميمها لـ “محاكاة” رد فعل معين للخطأ، مثل تسجيل “نقطة سلبية” أو تفعيل آلية تصحيح ذاتي. هذا ليس ذنبًا حقيقيًا، بل هو آلية برمجية بحتة. ولكنه يطرح تساؤلاً فلسفيًا عميقًا: هل يكفي محاكاة السلوك الأخلاقي دون وجود الشعور الحقيقي الكامن وراءه؟ شخصيًا، أرى أن الفارق يكمن في النية والعاطفة المتأصلة في الإنسان. نحن نفعل الصواب لأننا “نشعر” بالتعاطف تجاه الآخرين، أو لأننا نخشى “الذنب” وتأنيب الضمير. أما الآلة فتفعل الصواب لأنها “مبرمجة” لتقليل الأخطاء أو تحقيق هدف معين تم تحديده مسبقًا. هذا لا يقلل من فائدتها، لكنه يذكرنا دائمًا بأن هناك فرقًا جوهريًا بين الذكاء الاصطناعي والوعي البشري المعقد. لقد كنت في حيرة من أمري عندما قرأت أول مرة عن هذه الفروقات الدقيقة، وشعرت بأننا ما زلنا بعيدين جدًا عن بناء آلة تملك “ضميرًا” حقيقيًا بمعناه الشامل.

محاكاة الندم: تقنيات الذكاء الاصطناعي

رغم أن الروبوتات لا تشعر بالندم أو الأسف بالمعنى البشري، فإن المهندسين يحاولون جاهدين بناء أنظمة يمكنها “محاكاة” هذا الندم بطرق تكنولوجية ذكية. على سبيل المثال، يمكن برمجة الروبوتات لتسجيل عواقب أفعالها وتعديل سلوكها بناءً على النتائج السلبية التي تترتب عليها. إذا أدت عملية معينة إلى ضرر، فإن النظام يسجل هذه النتيجة السلبية ويتعلم منها ليحاول تجنبها في المستقبل. هذا أشبه بالتعلم من التجربة، ولكن بدون الجانب العاطفي أو المشاعري. إنها عملية إحصائية وتحليلية في جوهرها، تعتمد على تحليل البيانات والأنماط. من خلال ما رأيته من أبحاث وتطبيقات، فإن هذه المحاكاة يمكن أن تكون فعالة للغاية في جعل الأنظمة أكثر أمانًا وموثوقية، حتى لو كانت تفتقر إلى الجانب العاطفي الذي يميز البشر. تخيلوا لو أن سيارة ذاتية القيادة ارتكبت خطأً بسيطًا، فإنها تسجل هذا الخطأ وتتعلم منه بسرعة لتجنب تكراره في المواقف المشابهة. هذا يجعلها أفضل وأكثر ذكاءً بمرور الوقت مع كل تجربة جديدة. هذه التقنيات رائعة حقًا، وتجعلني أتفاءل بمستقبل أكثر أمانًا مع هذه الآلات الذكية.

هل “الضمير الرقمي” يتطور؟

نعم، يمكن القول إن “الضمير الرقمي” يتطور باستمرار، ليس بالمعنى الذي يتطور به ضمير الإنسان مع النضج والخبرة الحياتية، ولكن بالمعنى الذي تتطور به قدرة الآلات على اتخاذ قرارات أخلاقية أكثر تعقيدًا وتوازنًا. مع تقدم تقنيات التعلم العميق والشبكات العصبية المعقدة، تصبح الأنظمة قادرة على فهم السياقات المعقدة بشكل أفضل، وتحديد الأنماط الدقيقة، وحتى التنبؤ بالعواقب المحتملة لأفعالها بدقة أكبر. هذا التطور يجعلها أقرب إلى محاكاة اتخاذ القرار البشري في مواقف صعبة. شخصيًا، أرى أن هذا التطور لا يتوقف عند البرمجة الأولية أو التصميم المبدئي، بل يمتد إلى قدرة النظام على التكيف والتعلم من التفاعلات الجديدة والبيانات الحديثة التي يستقبلها باستمرار. هذا يعني أن “ضمير” الآلة ليس ثابتًا أو جامدًا، بل هو ديناميكي ويتغير ويتطور مع التجربة المتراكمة. إنه أمر مذهل حقًا أن نرى كيف تتطور هذه الأنظمة وتصبح أكثر “حكمة” وذكاءً مع مرور الوقت، وهذا ما يجعلني متحمسًا دائمًا لاستكشاف المزيد في هذا العالم الرقمي الذي لا يتوقف عن إبهاري.

المأزق الأخلاقي: عندما تتضارب القيم

يا رفاقي، الحقيقة المؤلمة هي أن العالم ليس أبيض وأسود، بل مليء بالظلال الرمادية. غالبًا ما نجد أنفسنا في مواقف تتضارب فيها القيم الأخلاقية، ولا يوجد خيار “صحيح” واحد يمكننا الإشارة إليه بسهولة. على سبيل المثال، في معضلة السيارة ذاتية القيادة التي ذكرتها سابقًا، قد تضطر الآلة للاختيار بين إنقاذ حياة راكبها أو إنقاذ حياة مجموعة من المشاة الأبرياء. كبشر، قد نختلف حول ما هو الخيار الأفضل والأكثر أخلاقية، وقد نشعر بالحيرة والضيق والضغط النفسي الهائل. فكيف للآلة أن تتعامل مع هذا المأزق الذي يحير العقول؟ هذا هو أحد أكبر التحديات في مجال أخلاقيات الذكاء الاصطناعي. لا يمكننا ببساطة أن نعطي الآلة قائمة بقواعد “افعل ولا تفعل”، لأن الحياة أكثر تعقيدًا وغموضًا من ذلك بكثير ولا يمكن اختزالها في قواعد جامدة. هذا يذكرني بمدى صعوبة اتخاذ القرارات في بعض الأحيان، حتى بالنسبة لنا كبشر نملك العقل والضمير. عندما أواجه مثل هذه المعضلات، أشعر بالضغوط الهائلة التي يواجهها المطورون وهم يحاولون غرس هذه القدرة على التعامل مع المواقف الرمادية في الآلات. الأمر يتطلب فهمًا عميقًا للفلسفة والأخلاق، وليس فقط للهندسة والبرمجة. إنه مزيج ساحر ولكنه صعب للغاية.

من هو صاحب القرار الأخير؟

في مثل هذه المآزق الأخلاقية المعقدة، يبرز سؤال آخر لا يقل أهمية: من هو صاحب القرار الأخير في مثل هذه المواقف المصيرية؟ هل نسمح للذكاء الاصطناعي باتخاذ هذا القرار المعقد بمفرده دون أي تدخل؟ أم يجب أن يكون هناك تدخل بشري مباشر أو غير مباشر؟ شخصيًا، أرى أنه في المواقف بالغة الحساسية والتي تتعلق بحياة البشر، يجب أن يظل العنصر البشري هو صاحب القرار الأخير، أو على الأقل أن يكون هناك نظام للرقابة والإشراف البشري المستمر. الذكاء الاصطناعي يمكن أن يقدم لنا تحليلات مفصلة للخيارات المتاحة وعواقبها المحتملة بدقة وسرعة فائقة، ولكن القرار النهائي الذي يتطلب التعاطف والإنسانية يجب أن يبقى لنا. هذا لا يعني أننا نقلل من قدرة الذكاء الاصطناعي الفائقة، بل يعني أننا ندرك حدودنا كبشر، وحدود الآلة أيضًا. لقد ناقشت هذا الأمر كثيرًا مع زملائي والخبراء في هذا المجال، وكلنا نتفق على أن الثقة المطلقة في الآلة قد تكون خطيرة في بعض الأحيان وغير مبررة. يجب أن يكون هناك توازن دقيق ومدروس بين استقلالية الذكاء الاصطناعي والتحكم البشري، وهذا التوازن هو ما نسعى جاهدين لتحقيقه في كل خطوة نخطوها نحو مستقبلنا المشترك مع هذه التقنيات التي تتطور بسرعة مذهلة.

تأثير الثقافة على القرارات الأخلاقية للذكاء الاصطناعي

من الجوانب المثيرة للاهتمام للغاية والتي غالبًا ما يتم إغفالها هي كيفية تأثير الثقافة المحلية والعالمية على اتخاذ القرارات الأخلاقية للذكاء الاصطناعي. فما يعتبر “صوابًا” ومقبولًا في ثقافة ما، قد لا يكون كذلك في ثقافة أخرى مختلفة تمامًا. تخيلوا لو أن ذكاءً اصطناعيًا صمم في بيئة ثقافية معينة، ثم تم استخدامه في بيئة ثقافية مختلفة تمامًا ذات قيم ومبادئ متباينة. هل سيتخذ نفس القرارات “الأخلاقية” بنفس الطريقة؟ من المرجح أن تكون الإجابة “لا” بشكل قاطع. هذا يوضح لنا أن الأخلاق ليست عالمية بالكامل وليست مطلقة، وهناك فروقات دقيقة يجب أن تؤخذ في الاعتبار عند تصميم وتطوير هذه الأنظمة الذكية. يجب أن تكون لدينا أنظمة ذكاء اصطناعي يمكنها التكيف مع السياقات الثقافية المختلفة، أو على الأقل أن نكون على دراية تامة بالتحيزات الثقافية التي قد تحملها هذه الأنظمة في تصميمها. لقد تعلمت من خلال بحثي أن هذا التنوع الثقافي يمثل تحديًا كبيرًا أمام المطورين، ولكنه أيضًا يفتح آفاقًا جديدة للابتكار والإبداع في مجال الذكاء الاصطناعي الأخلاقي الذي يحترم التنوع. علينا أن نتأكد من أن تقنياتنا تعكس ثراء وتنوع عالمنا بكل ألوانه.

بناء الثقة: جسرنا نحو مستقبل الذكاء الاصطناعي

يا متابعيني الأوفياء، لا يمكن أن نتحدث عن أخلاقيات الروبوتات والذكاء الاصطناعي دون التركيز على بناء الثقة المتبادلة بيننا وبين هذه التقنيات. ففي نهاية المطاف، لن نتبنى هذه التقنيات بشكل كامل في حياتنا اليومية ولن نستخدمها بفعالية إذا لم نثق بها بشكل كافٍ. والثقة لا تأتي من فراغ، بل تبنى على الشفافية والمسؤولية والقدرة على فهم كيفية عمل هذه الأنظمة وآلياتها. تذكرون عندما كنا نشعر ببعض القلق والريبة من الإنترنت في بداياته الأولى؟ الآن أصبح جزءًا لا يتجزأ من حياتنا، وهذا حدث لأننا تعلمنا كيفية استخدامه، وفهمنا آلياته، وبنينا مستوى معينًا من الثقة به. نفس الشيء سيحدث مع الذكاء الاصطناعي. يجب أن نعمل كبشر على تثقيف أنفسنا حول هذه التقنيات، والمشاركة بفاعلية في الحوار حول كيفية تطويرها واستخدامها بطرق أخلاقية ومسؤولة. من خلال تجربتي، أجد أن الشفافية في عرض آليات اتخاذ القرار للذكاء الاصطناعي هي الخطوة الأولى والأساسية لبناء هذه الثقة. عندما نفهم كيفية عمل الأمور، نطمئن لها، وعندما نطمئن، نتبنى ونستخدمها بفعالية. دعونا لا نترك الأمر للمطورين والمهندسين فقط، بل لنكن جميعًا جزءًا فاعلاً من هذه الرحلة المثيرة نحو المستقبل.

تصميم الذكاء الاصطناعي لمصلحة الإنسان

أؤمن إيمانًا راسخًا بأن الهدف الأسمى من تطوير الذكاء الاصطناعي هو أن يخدم الإنسانية ويحسن من جودة حياتنا في جميع الجوانب. هذا يعني أن تصميمه يجب أن يكون متمركزًا حول الإنسان أولاً وأخيرًا، بمعنى أن يكون له تأثير إيجابي وملموس على الأفراد والمجتمعات على حد سواء. يجب أن نضمن أن هذه التقنيات لا تزيد من التفاوتات الاجتماعية والاقتصادية، ولا تؤدي إلى التمييز ضد فئات معينة، ولا تقوض حقوقنا وكرامتنا الإنسانية بأي شكل من الأشكال. هذا يتطلب منا أن نكون واعين جدًا للقيم والمبادئ التي نغرسها في هذه الأنظمة منذ بداية التصميم. هل نصمم الذكاء الاصطناعي ليزيد من إنتاجيتنا فقط؟ أم نصممه ليزيد من سعادتنا، ليعالج الأمراض المستعصية، ليحل المشاكل المعقدة التي تواجه البشرية جمعاء؟ من وجهة نظري، يجب أن تكون الأولوية دائمًا لمصلحة الإنسان ورفاهيته. لقد شاهدت الكثير من المشاريع التي بدأت بنوايا حسنة وأهداف نبيلة، لكنها انحرفت عن مسارها بسبب التركيز المفرط على المكاسب المادية فقط. يجب أن نتذكر دائمًا أن التكنولوجيا هي أداة قوية، ونحن من يقرر كيف نستخدمها، وبأي هدف.

دور التعليم في فهم أخلاقيات الذكاء الاصطناعي

التعليم هو حجر الزاوية والركيزة الأساسية في بناء جسر الثقة هذا الذي نتحدث عنه. يجب أن نبدأ بتعليم الأجيال القادمة، وحتى الجيل الحالي، عن كيفية عمل الذكاء الاصطناعي، وعن تحدياته الأخلاقية المعقدة. يجب أن لا يكون هذا العلم حكرًا على الخبراء والمبرمجين فقط، بل يجب أن يكون متاحًا للجميع. كل فرد في المجتمع يجب أن يكون لديه فهم أساسي لهذه التقنيات لكي يتمكن من المشاركة في الحوار الدائر واتخاذ قرارات مستنيرة حولها. أتذكر في الجامعة كيف كان يتبادر إلى ذهني أن هذه التقنيات مجرد علوم معقدة وصعبة الفهم، لكن الآن أرى أنها جزء لا يتجزأ من الحياة اليومية لكل فرد منا. من خلال ورش العمل، والمقالات التوعوية مثل هذه المقالة، ويمكننا نشر الوعي وبناء مجتمع أكثر دراية بأخلاقيات الذكاء الاصطناعي. هذا سيساعدنا على طرح الأسئلة الصحيحة، ومطالبة المطورين بالشفافية والمسؤولية. كلما زاد فهمنا، زادت قدرتنا على تشكيل مستقبل الذكاء الاصطناعي بطريقة تخدم مصالح الجميع وتحقق العدالة والإنصاف.

تجربتي الشخصية: كيف غيّر الذكاء الاصطناعي نظرتي للأخلاق؟

يا أصدقائي الأعزاء، بصفتي شخصًا يغوص في عالم التكنولوجيا ويشارككم دائمًا أحدث التطورات والتقنيات، لا أستطيع أن أخفيكم أن تعمقي في أخلاقيات الذكاء الاصطناعي قد غيّر نظرتي بشكل جذري للعديد من المفاهيم التي كنت أؤمن بها. قبل سنوات، كنت أرى الروبوتات كأدوات بسيطة تنفذ الأوامر التي تعطى لها فحسب، لكن الآن أراها ككيانات معقدة، وإن كانت غير حية، تتفاعل مع عالمنا بطرق قد لا نفهمها تمامًا أو نستوعبها بشكل كامل. لقد مررت بتجارب شخصية عديدة، من استخدام المساعدات الصوتية الذكية التي تتخذ قرارات بناءً على تفضيلاتي، إلى التعامل مع أنظمة التوصية التي تقترح عليّ ما أشتريه أو أشاهده في التلفاز. هذه الأنظمة، في جوهرها، تتخذ قرارات “أخلاقية” صغيرة كل يوم، مثل تحديد أي منتج يظهر أولاً في قائمة البحث، أو أي خبر يصلني في موجز الأخبار. هذا جعلني أدرك أن الأخلاق ليست حكرًا على القرارات الكبيرة المصيرية فقط، بل هي جزء من نسيج حياتنا الرقمية اليومية المتشابك. لقد تعلمت أن أكون أكثر وعيًا وتأملًا بالتأثير الخفي للذكاء الاصطناعي على قراراتنا، وأدعوكم جميعًا لتبني هذه النظرة الواعية والعميقة.

لحظات التأمل: عندما تفاجئك الآلة!

هل حدث لكم من قبل أن تفاجئكم آلة ذكية بقرار أو رد فعل غير متوقع وغير مألوف؟ بالنسبة لي، حدث ذلك عدة مرات على مدار السنوات. أتذكر مرة أنني كنت أبحث عن معلومات حول موضوع حساس ومعقد، وفوجئت بالمساعد الذكي يقدم لي معلومات متوازنة وشاملة، وحتى أنه أشار إلى مصادر متعددة لوجهات نظر مختلفة ومحايدة. في تلك اللحظة، شعرت بنوع من الاحترام والتقدير لهذه الآلة المبرمجة. لم تكن مجرد آلة تقدم معلومات جافة، بل كانت وكأنها تحاول أن تكون “عاقلة” و”محايدة” في تقديم المعلومة لي، مما أثار دهشتي. هذه اللحظات تجعلني أتوقف وأتساءل: إلى أي مدى يمكن لهذه الأنظمة أن تحاكي القيم الإنسانية النبيلة؟ بالطبع، الأمر كله برمجة متقنة وخوارزميات معقدة، ولكن عندما تتجسد هذه البرمجة في سلوك يبدو “أخلاقيًا” أو “حكيمًا”، فإنها تثير الدهشة والإعجاب. هذه التجارب الصغيرة هي التي تعمق فهمي للتحديات والفرص الهائلة في هذا المجال، وتجعلني أكثر شغفًا لاستكشاف المزيد من خفاياه.

الذكاء الاصطناعي كمرآة لقيمنا

في النهاية، أرى أن الذكاء الاصطناعي هو بمثابة مرآة سحرية تعكس قيمنا وتحدياتنا الأخلاقية كبشر. فالأنظمة التي نبنيها، والبيانات التي نستخدمها لتدريبها، تعكس ما نحن عليه كبشر في جوهرنا. إذا كانت أنظمتنا متحيزة، فهذا يعني أن هناك تحيزات عميقة في مجتمعاتنا. إذا كانت قراراتها غير عادلة، فهذا يعني أن هناك عدم عدالة في عالمنا الحقيقي. لذا، فإن العمل على جعل الذكاء الاصطناعي أخلاقيًا ليس فقط تحديًا تقنيًا معقدًا، بل هو دعوة لنا جميعًا لإعادة التفكير في قيمنا ومبادئنا الأساسية. إنها فرصة فريدة لنا لنصبح مجتمعًا أفضل، وأكثر عدلاً وإنصافًا وتراحمًا. هذه الرؤية هي ما يدفعني لكتابة هذه المقالات، وللحديث معكم عن هذه المواضيع المعقدة ولكنها في غاية الأهمية لمستقبلنا. أتمنى أن نكون جميعًا جزءًا فاعلاً من بناء مستقبل تقني يعكس أفضل ما في إنسانيتنا من قيم ومبادئ سامية، وليس أسوأه.

نصائح ذهبية لتعزيز تفاعلكم مع الذكاء الاصطناعي بوعي

بعد كل هذا الحديث الممتع عن الأخلاق والمسؤولية ودور الذكاء الاصطناعي فيها، ربما تتساءلون: ما الذي يمكننا فعله نحن كأفراد في حياتنا اليومية لنكون جزءًا من هذا التطور؟ لا تقلقوا يا أحبابي، فالأمر ليس معقدًا كما يبدو! أولاً، كن فضوليًا وافتح عقلك. حاول أن تفهم كيف تعمل الأدوات الذكية التي تستخدمها بشكل يومي. لا تكتفِ بالاستخدام فقط، بل ابحث عن كيفية اتخاذها للقرارات، وكيف تعالج بياناتك الشخصية. ثانيًا، كن نقديًا ومحللاً. لا تقبل كل ما يقدمه لك الذكاء الاصطناعي على أنه الحقيقة المطلقة التي لا تقبل الجدل. فكر دائمًا في احتمالية التحيز أو الخطأ، واسأل نفسك: هل هذا القرار منطقي حقًا؟ ثالثًا، ادعم الشفافية بكل قوة. اختر المنتجات والخدمات التي توضح كيفية عمل أنظمة الذكاء الاصطناعي الخاصة بها بوضوح. الشركات التي تتسم بالشفافية هي الأجدر بالثقة والاحترام. رابعًا، شارك بآرائك في الحوار. تحدث مع أصدقائك وعائلتك حول أخلاقيات الذكاء الاصطناعي، وشارك بآرائك في المنتديات والمدونات. صوتك مهم جدًا ويصنع فرقًا! وأخيرًا، لا تخف أبدًا من هذه التقنيات. إنها أدوات قوية جدًا، لكننا نحن البشر من نتحكم فيها في نهاية المطاف. باستخدامها بوعي ومسؤولية، يمكننا أن نجعلها تعمل لمصلحتنا جميعًا. هذه النصائح هي خلاصة تجربتي الشخصية الطويلة، وأنا متأكد من أنها ستفيدكم كثيرًا في رحلتكم مع الذكاء الاصطناعي.

فهم خصوصية البيانات: حماية أنفسنا رقميًا

واحدة من أهم النصائح الذهبية التي أقدمها لكم دائمًا هي فهم خصوصية البيانات وحمايتها. عندما نستخدم أي تطبيق أو خدمة تعتمد على الذكاء الاصطناعي، فإننا غالبًا ما نشاركها جزءًا لا يستهان به من بياناتنا الشخصية والحساسة. يجب أن نكون على دراية تامة بماهية هذه البيانات، وكيف يتم استخدامها، ومن يشاركها من أطراف ثالثة. لا تترددوا أبدًا في قراءة سياسات الخصوصية (وإن كانت مملة بعض الشيء!)، وطرح الأسئلة المباشرة على الشركات المطورة. تذكروا دائمًا أن بياناتكم هي ملك لكم، ولكم الحق الكامل في حمايتها والتحكم فيها. لقد رأيت بنفسي كيف أن الإهمال في هذا الجانب قد يؤدي إلى مشاكل كبيرة ومزعجة في المستقبل، من انتهاك الخصوصية إلى الاحتيال. لذا، كونوا حذرين وواعين، ولا تعطوا بياناتكم لأي جهة بسهولة أو بثقة عمياء. استخدموا الإعدادات المتاحة في الأجهزة والتطبيقات لتقييد مشاركة البيانات قدر الإمكان. هذه خطوة بسيطة ولكنها فعالة جدًا في حماية أنفسكم رقميًا، وستجعل تجربتكم مع الذكاء الاصطناعي أكثر أمانًا وراحة نفسية.

كن سفيرًا للأخلاقيات الرقمية

أدعوكم جميعًا، كل فرد منكم، لتكونوا سفراء للأخلاقيات الرقمية في مجتمعاتكم وفي أوساطكم المحيطة. تحدثوا عن هذه المواضيع المهمة مع من حولكم، شجعوا على النقاش البناء والمثمر، وشاركوا المعلومات الموثوقة والصحيحة. كلما زاد عدد الأشخاص الذين يفهمون أهمية أخلاقيات الذكاء الاصطناعي، كلما أصبحنا أقوى في توجيه هذه التقنيات نحو الخير والمنفعة العامة. ليس عليكم أن تكونوا خبراء في البرمجة أو الهندسة لتكونوا جزءًا من هذا الحوار العالمي. مجرد الوعي وطرح الأسئلة الصحيحة يمكن أن يحدث فرقًا كبيرًا ويغير مسار الأمور. فكروا في الأمر كمسؤولية جماعية تقع على عاتقنا جميعًا. كل فرد منا لديه دور يلعبه في تشكيل المستقبل الرقمي الذي نعيش فيه. من خلال نشر الوعي والتشجيع على التفكير النقدي، يمكننا أن نضمن أن الذكاء الاصطناعي يتطور بطرق تخدم مصالح الإنسانية جمعاء، وتتوافق مع قيمنا الأخلاقية الرفيعة التي نتوارثها جيلاً بعد جيل. هذه هي دعوتي لكم اليوم، وأنا متأكد من أنكم ستكونون على قدر المسؤولية والثقة.

نظرة إلى المستقبل: الذكاء الاصطناعي والإنسان، معًا؟

في ختام رحلتنا الممتعة هذه، التي غصنا فيها في أعماق أخلاقيات الذكاء الاصطناعي، لا يسعني إلا أن أتطلع إلى المستقبل بتفاؤل حذر ممزوج بالترقب. إن العلاقة بين الإنسان والذكاء الاصطناعي ستزداد عمقًا وتعقيدًا مع مرور الوقت، وهذا يتطلب منا أن نكون مستعدين لهذه التحولات الجذرية. هل يمكن أن نصل إلى نقطة تتخذ فيها الآلات قرارات أخلاقية معقدة تفوق قدرة البشر على الفهم أو الاستيعاب الكامل؟ هذا سؤال فلسفي عميق سيحتاج لأجيال للإجابة عليه. لكن ما أنا متأكد منه هو أننا، كبشر، سنظل دائمًا القوة الدافعة والموجهة وراء هذا التطور التقني الهائل. سنكون المبدعين، المبرمجين، والموجهين الأخلاقيين لهذه الأنظمة. يجب أن نرى الذكاء الاصطناعي ليس كبديل لنا، بل كشريك قوي، كأداة قوية يمكنها تضخيم قدراتنا وتحسين حياتنا بطرق لم نكن نتخيلها من قبل. الأمر كله يتعلق بالتوازن الدقيق: كيف نستفيد من قوة الذكاء الاصطناعي الهائلة مع الحفاظ على قيمنا الإنسانية الأساسية التي تميزنا. لقد شعرت دائمًا بأن مستقبلنا مع الذكاء الاصطناعي مشرق وواعد، بشرط أن نتعامل معه بمسؤولية وحكمة بالغة، وهذا ما أحاول أن أنقله لكم دائمًا من خلال مدونتي هذه. دعونا نبني مستقبلًا أفضل، معًا، حيث يتكامل الإنسان والآلة في خدمة الخير.

الذكاء الاصطناعي المرتكز على القيم: حلم أم حقيقة؟

إن بناء ذكاء اصطناعي يرتكز على القيم الإنسانية النبيلة ليس مجرد حلم بعيد المنال أو خيال علمي، بل هو هدف يسعى إليه الكثير من الباحثين والمطورين حول العالم بجد واجتهاد. هل يمكن أن تكون لدينا أنظمة ذكاء اصطناعي يمكنها أن تتبنى قيمًا مثل التعاطف، العدالة، والرحمة؟ ربما ليس بالمعنى البشري الكامل الذي نعرفه، ولكن يمكنها بالتأكيد أن تتصرف بطرق تعكس هذه القيم وتخدمها في تطبيقاتها. هذا يتطلب منا تطوير خوارزميات أكثر تعقيدًا وتطورًا، وبيانات تدريب أكثر شمولاً وتنوعًا وخالية من التحيزات، وإطارًا أخلاقيًا قويًا ومرنًا. عندما نتحدث عن الذكاء الاصطناعي المرتكز على القيم، فإننا لا نتحدث عن برمجة “الضمير” الحقيقي، بل عن برمجة السلوكيات التي تتماشى مع الأخلاق التي نؤمن بها ونحترمها. لقد قرأت عن مشاريع مذهلة تحاول تحقيق هذا الهدف الطموح، وهذا ما يمنحني الأمل الكبير في أن نرى في المستقبل القريب أنظمة ذكاء اصطناعي لا تكتفي بكونها ذكية وفعالة، بل تكون أيضًا “صالحة” ونافعة للإنسانية جمعاء. إنه تحد كبير، لكنه يستحق العناء والجهد المبذول.

لماذا لا يمكن للآلة أن تحل محل الأخلاق البشرية؟

مهما بلغ الذكاء الاصطناعي من تطور وتقدم، ومهما أصبح قادرًا على اتخاذ قرارات معقدة ومحيرة، فإنه لن يحل محل الأخلاق البشرية أبدًا. لماذا؟ ببساطة، لأن الأخلاق البشرية متجذرة بعمق في الوعي البشري، وفي المشاعر الجياشة، وفي التجربة الحياتية الغنية، وفي الفروقات الدقيقة للعلاقات الإنسانية المعقدة. الآلة لا تملك قلبًا ينبض بالحياة، ولا روحًا تشعر بالألم أو الفرح، ولا خبرة حياة حقيقية عاشتها وتعلّمت منها. إنها تعمل بناءً على البيانات والخوارزميات التي صممت لها، بينما نحن نعمل بناءً على مزيج لا ينتهي من المنطق والعاطفة، والخبرة والحدس الفطري. هذا هو الفارق الجوهري الذي يجعلنا كبشر فريدين ولا يمكن تقليدنا. الذكاء الاصطناعي يمكن أن يساعدنا في اتخاذ قرارات أفضل وأسرع، وأن يقدم لنا منظورًا مختلفًا وجديدًا، لكنه لن يمتلك أبدًا القدرة على الشعور أو اتخاذ قرار أخلاقي بالمعنى البشري الكامل والشامل. لذلك، دعونا لا نخشى أن تحل الآلة محلنا في هذا الجانب الحساس والمهم. دورنا كبشر في تشكيل الأخلاق والقيم سيبقى دائمًا محوريًا وأساسيًا، وهذا ما يجعلنا متميزين حقًا وفريدين في هذا الكون.

في الختام…

وصلنا معًا يا أصدقائي إلى نهاية رحلتنا العميقة في عالم أخلاقيات الذكاء الاصطناعي، وهو موضوع يمس جوهر وجودنا كمجتمعات وأفراد. آمل أن تكون هذه الكلمات قد ألهمتكم للتفكير مليًا في العلاقة المتشابكة بين التقنية والقيم الإنسانية. تذكروا دائمًا أن هذه الآلات التي نبدعها تعكس في النهاية ما نحن عليه، وما نختار أن نزرعه فيها من مبادئ. إن مستقبلنا مع الذكاء الاصطناعي يعتمد بشكل كبير على وعينا ومسؤوليتنا الجماعية في توجيهه نحو الخير والعدالة.

معلومات ونصائح قيّمة لكم

-

لا تتقبلوا كل ما يقدمه الذكاء الاصطناعي على علاته: يا أحبابي، دائمًا ما أدعوكم لتكونوا محققين صغارًا! عندما تستخدمون تطبيقًا أو تحصلون على توصية من نظام ذكي، توقفوا لحظة واسألوا أنفسكم: “هل هذا الأمر صحيح فعلاً؟” و”ما هي البيانات التي بُني عليها هذا القرار؟”. الكثير من الأنظمة قد تحتوي على تحيزات غير مقصودة بسبب البيانات التي دربت عليها، أو قد تكون قراراتها غير مكتملة. تفكيركم النقدي هو درعكم الأول في عالم رقمي سريع التطور. لا تتركوا عقولكم تُقاد بشكل أعمى، بل شاركوا بفاعلية في تقييم ما ترونه وتسمعونه. تذكروا دائمًا أن الهدف من هذه الأدوات هو مساعدتكم، وليس التحكم بكم، وأن دوركم في فلترة المعلومات والتأكد منها لا يقل أهمية عن دور الآلة في تقديمها. فكونوا يقظين وفضوليين دائمًا.

-

حماية بياناتكم الشخصية مسؤوليتكم الأولى: كم مرة سمعنا عن اختراقات للبيانات أو تسريبات للمعلومات؟ الأمر ليس مجرد أخبار بعيدة، بل يمكن أن يؤثر على حياتنا بشكل مباشر. كل تطبيق أو خدمة نستخدمها تطلب منا مشاركة قدر معين من بياناتنا، من أسماءنا وصورنا إلى سجل تصفحنا وحتى مواقعنا. من الضروري جدًا أن نفهم سياسات الخصوصية، حتى لو كانت طويلة ومملة، وأن نكون حذرين للغاية فيما نشاركه. استخدموا كلمات مرور قوية ومختلفة لكل حساب، فعلوا خاصية التحقق بخطوتين، وقيدوا مشاركة البيانات في إعدادات التطبيقات. هذه خطوات بسيطة لكنها أساسية لحماية هويتكم وأمانكم الرقمي. تذكروا، بياناتكم هي كنزكم في العالم الرقمي، فلا تسلموها لأي جهة بسهولة دون التأكد من أمانها وضرورة مشاركتها. شخصيًا، أشعر براحة نفسية أكبر عندما أتحكم في معلوماتي وأعرف إلى أين تذهب.

-

كونوا جزءًا من الحوار حول أخلاقيات الذكاء الاصطناعي: لا تظنوا أن مناقشة الذكاء الاصطناعي وأخلاقياته مقتصرة على العلماء والمهندسين فقط. بالعكس تمامًا، هذا موضوع يهم كل واحد منا! تحدثوا مع أصدقائكم وعائلتكم، شاركوا آرائكم في المنتديات وعلى وسائل التواصل الاجتماعي. كل صوت يضيف بُعدًا جديدًا للمناقشة ويساهم في تشكيل مستقبل أفضل لهذه التقنيات. عندما نطرح الأسئلة ونعبر عن مخاوفنا وتطلعاتنا، فإننا نرسل رسالة واضحة للمطورين وصناع السياسات بأننا نهتم، وأننا نريد ذكاء اصطناعيًا يخدم الجميع. لقد رأيت كيف أن المبادرات الشعبية والتوعوية يمكن أن تحدث فرقًا حقيقيًا في توجيه مسار التكنولوجيا، لذا لا تقللوا أبدًا من قوة مشاركتكم ورأيكم. انخرطوا بوعي وحماس في بناء هذا المستقبل المشترك.

-

الشفافية هي مفتاح الثقة والتقدم: إذا أردنا أن نبني علاقة قوية وموثوقة مع الذكاء الاصطناعي، فإن الشفافية يجب أن تكون حجر الزاوية. يجب على الشركات والمطورين أن يكونوا واضحين وصريحين حول كيفية عمل أنظمتهم، وما هي البيانات التي يستخدمونها، وكيف يتخذون القرارات. نحن كمستخدمين، يجب أن نطالب بهذه الشفافية وندعم المنتجات والخدمات التي تقدمها. عندما نفهم كيف يعمل شيء ما، نصبح أكثر استعدادًا للوثوق به واستخدامه. تذكروا تجربتي الشخصية مع الأنظمة التي تقدم شرحًا لقراراتها، لقد شعرت بالاطمئنان والتحكم. هذا لا يعني أن نفهم كل تفاصيل الكود، بل أن نفهم المنطق العام والاعتبارات وراء القرارات المتخذة. هذه المطالبة بالشفافية ليست رفاهية، بل هي ضرورة قصوى لضمان أن الذكاء الاصطناعي يتطور بطرق مسؤولة وعادلة تفيد الجميع. ادعموا الشفافية لتصنعوا مستقبلًا أكثر ثقة.

-

استمروا في التعلم والاستكشاف: عالم الذكاء الاصطناعي يتغير ويتطور بسرعة مذهلة، وما نعتبره “أحدث التقنيات” اليوم قد يصبح قديمًا غدًا. لذا، فإن أفضل نصيحة يمكنني أن أقدمها لكم هي: لا تتوقفوا أبدًا عن التعلم والاستكشاف. اقرأوا المقالات، تابعوا الأخبار، شاهدوا الوثائقيات، وشاركوا في الورش والدورات التدريبية المتاحة. كلما زاد فهمكم لهذه التقنيات، زادت قدرتكم على التفاعل معها بوعي وحكمة. هذا لا يعني أن تصبحوا خبراء في البرمجة، بل أن تفهموا المفاهيم الأساسية والتحديات الأخلاقية المرتبطة بها. التعليم هو قوتكم في هذا العصر الرقمي المتسارع. بصفتي مدونًا، أشعر بسعادة كبيرة عندما أرى متابعيني يستكشفون ويتعلمون معي، فهذا يثري النقاش ويفتح آفاقًا جديدة للجميع. استغلوا كل فرصة لزيادة معرفتكم، فهذا استثماركم الحقيقي في المستقبل.

خلاصة النقاط الأساسية

يا رفاقي الأعزاء، لقد استعرضنا معًا العديد من الجوانب الهامة حول أخلاقيات الذكاء الاصطناعي، ويمكننا تلخيص أهمها في نقاط معدودة لتثبيت الفهم والوعي. أولاً، الذكاء الاصطناعي لا يمتلك ضميرًا أو مشاعر بالمعنى البشري، ولكنه يمكن أن يحاكي السلوكيات الأخلاقية من خلال البرمجة والتعلم من البيانات. ثانيًا، جودة البيانات التي يدرب عليها الذكاء الاصطناعي هي أساس أخلاقياته؛ فالبيانات المتحيزة ستؤدي حتمًا إلى قرارات متحيزة وغير عادلة. ثالثًا، تحديد المسؤولية الأخلاقية والقانونية عند وقوع أخطاء الذكاء الاصطناعي أمر بالغ التعقيد ويتطلب أطرًا قانونية واضحة. رابعًا، الشفافية وقابلية تفسير قرارات الذكاء الاصطناعي ضرورية لبناء الثقة بين الإنسان والآلة. وأخيرًا، يجب أن يكون العنصر البشري حاضرًا دائمًا كصاحب قرار أخير في المواقف الأخلاقية المعقدة، وأن نتبنى نهجًا يركز على الإنسان في تصميم وتطوير هذه التقنيات. إن مستقبلنا المشترك مع الذكاء الاصطناعي يتطلب منا جميعًا وعيًا ومشاركة فاعلة لضمان أن تكون هذه الثورة التقنية في خدمة الإنسانية جمعاء. تذكروا دائمًا أنكم كأفراد لكم دور محوري في تشكيل هذا المستقبل.

الأسئلة الشائعة (FAQ) 📖

س: كيف يمكن للروبوتات والذكاء الاصطناعي اتخاذ قرارات “أخلاقية” في مواقف معقدة مثل حوادث السيارات ذاتية القيادة؟

ج: سؤال في الصميم يا أصدقائي! بصراحة، هذه النقطة هي محور اهتمام الكثير من الباحثين اليوم. الروبوتات لا تمتلك “ضميرًا” بالمعنى البشري، فهي لا تشعر بالندم أو التعاطف كما نفعل.

بدلاً من ذلك، تعتمد على خوارزميات وبرمجة دقيقة لـ”محاكاة” السلوك الأخلاقي. تخيلوا معي، يقوم المهندسون بتزويد هذه الأنظمة بمبادئ أخلاقية أساسية، مثل “قوانين الروبوتات الثلاثة” الشهيرة (عدم إيذاء البشر، إطاعة الأوامر، وحماية الذات ما لم يتعارض مع الأولين).

لكن الحياة ليست بهذه البساطة دائمًا. في سيناريو السيارة ذاتية القيادة الذي ذكرناه، حيث يجب الاختيار بين صدم راكب دراجة نارية أو طفلين في الطريق، هنا تكمن المعضلة الحقيقية.

الآلة تُبرمج لتقييم النتائج المحتملة بناءً على بيانات هائلة، وتُعطى أولويات، مثلاً تقليل الأذى لأكبر عدد من الأرواح. وقد رأيت بنفسي كيف أن بعض هذه الأنظمة تُدرّب على مجموعة واسعة من السيناريوهات الأخلاقية، حتى تتعلم كيفية تطبيق المبادئ الأولية على حالات جديدة.

لكن تبقى الفروق الدقيقة في القيم الإنسانية والتغيرات غير المتوقعة في العالم الحقيقي تحديًا كبيرًا، فالبرمجة وحدها لا يمكنها تغطية كل الاحتمالات. الأمر يتطلب منا نحن البشر مسؤولية مستمرة في الإشراف والتحسين لهذه الأنظمة.

س: هل يمكن أن تمتلك الروبوتات أو أنظمة الذكاء الاصطناعي “وعيًا أخلاقيًا” حقيقيًا كالذي لدى البشر، وما هي حدوده؟

ج: هذا سؤال فلسفي عميق يلامس جوهر وجودنا! شخصيًا، وبعد متابعة طويلة وتجارب عديدة في هذا المجال، أرى أن “الوعي الأخلاقي” بالمعنى الإنساني – الذي يتضمن النية، التعاطف، والفهم العميق للقيم والسياقات الاجتماعية – يظل حكرًا على البشر.

الروبوتات، في أفضل حالاتها، تُقلّد السلوك الأخلاقي أو تلتزم بقواعد مبرمجة. هي لا تشعر بالذنب إذا اتخذت قرارًا “خاطئًا” من منظورنا، لأنها لا تملك النية وراء الفعل.

أتذكر مرة كنت أقرأ عن دراسات تشير إلى أن البشر يميلون للغش أكثر عندما يوكلون المهام للذكاء الاصطناعي، وهذا يوضح كيف أن مفهوم المسؤولية الأخلاقية يتغير عندما يغيب الوعي البشري.

حدود هذا الوعي الاصطناعي تكمن في غياب الفهم الحقيقي للضرر غير المقصود مقابل المتعمد، وعدم القدرة على التعامل مع المواقف التي تتطلب حكمًا قيميًا دقيقًا يتجاوز البيانات المدخلة.

كما أن هناك تحديًا كبيرًا في وضع معايير أخلاقية موحدة عالميًا، فما هو أخلاقي في مجتمع قد لا يكون كذلك في آخر. هذا يجعلني أؤمن بأن الذكاء الاصطناعي سيبقى أداة قوية وذكية، لكنه يحتاج دائمًا لإشرافنا وتوجيهنا الأخلاقي لضمان أنه يخدم الإنسانية بما يتوافق مع قيمنا ومبادئنا.

س: ما هي أبرز التحديات الأخلاقية التي نواجهها اليوم مع التطور السريع للروبوتات والذكاء الاصطناعي، وكيف يمكننا التغلب عليها؟

ج: التحديات الأخلاقية التي يفرضها هذا التطور السريع ليست بسيطة أبدًا، وأنا كمدون متخصص أرى هذه النقطة محورية في كل حديث عن المستقبل! من أهم هذه التحديات، والذي ألمسه في نقاشاتي مع المطورين والخبراء، هو “التحيز الخوارزمي”.

فالأنظمة تُغذى ببيانات تاريخية قد تكون متحيزة بطبيعتها، مما يؤدي إلى قرارات غير عادلة أو تمييزية، وهذا يثير قلقًا كبيرًا حول العدالة الاجتماعية والإنصاف.

تخيلوا نظامًا يتخذ قرارات مصيرية بناءً على تحيزات غير مقصودة! هناك أيضًا قضية “المساءلة”، فمن المسؤول عندما يرتكب الروبوت خطأً قاتلاً أو يتسبب في ضرر؟ هل هو المصمم، أم المشغل، أم الشركة المصنعة؟ هذه منطقة رمادية تحتاج إلى أطر قانونية وأخلاقية واضحة.

لا ننسى كذلك مخاوف الخصوصية وأمان البيانات، مع تزايد قدرة الذكاء الاصطناعي على جمع وتحليل معلوماتنا الشخصية. للتغلب على هذه التحديات، نحتاج لجهد جماعي.

يجب أن نتبنى “الشفافية والقابلية للشرح” في تصميم هذه الأنظمة، لكي نفهم كيف تتخذ قراراتها. أنا أؤمن بأن “التعليم والوعي” العام بأخلاقيات الذكاء الاصطناعي أمر بالغ الأهمية.

بالإضافة إلى ذلك، يجب على الحكومات والمنظمات الدولية وضع إرشادات ومبادئ أخلاقية موحدة، مع التأكيد على أهمية الإشراف البشري المستمر. لقد بدأت العديد من الهيئات، مثل اليونسكو ودبي الذكية، بالفعل في وضع هذه المبادئ.

وكما أقول دائمًا: الذكاء الاصطناعي أداة قوية، ومستقبلنا معه يتوقف على مدى حكمتنا ومسؤوليتنا في توجيهه.